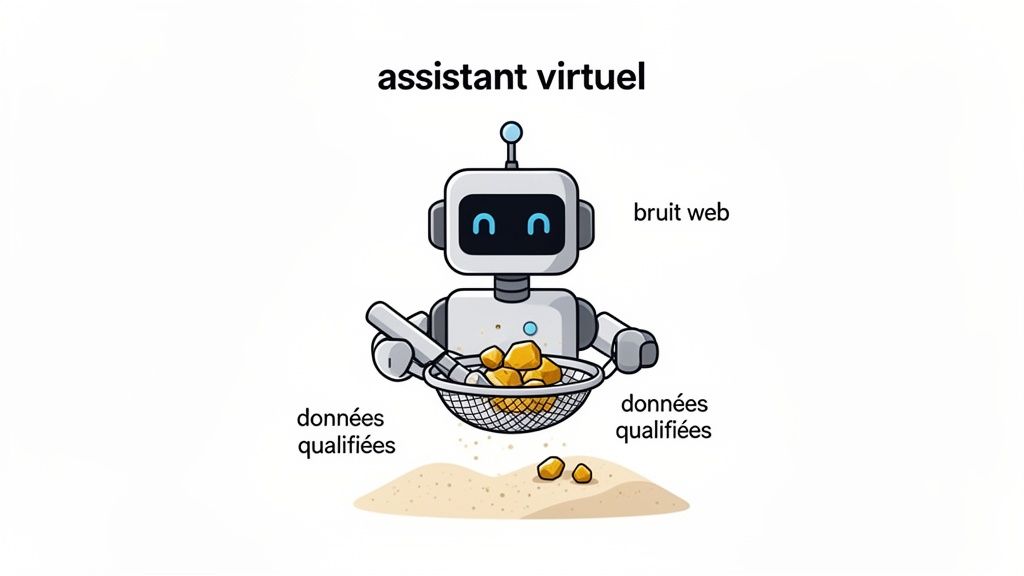

Le scraping de données, en termes simples, c'est l'art d'utiliser un robot pour aller chercher automatiquement des informations publiques sur des sites web. Imaginez un assistant virtuel ultra-rapide qui épluche des milliers de pages pour vous ramener exactement les données qui vous intéressent. Finies les longues heures de copier-coller manuel.

Comprendre le scraping de données, sans le jargon technique

Pour bien comprendre, prenons une analogie. Vous êtes un chercheur d'or des temps modernes. Votre trésor ? Ce ne sont pas des pépites de métal, mais des contacts de prospects qualifiés. Le web est votre rivière : immense, pleine de sable et de cailloux, mais aussi de ces précieuses pépites d'or.

Le scraping, c'est votre tamis high-tech. Au lieu de passer des jours entiers à filtrer manuellement des tonnes de sable (les infos inutiles) pour trouver quelques maigres pépites (les données pertinentes), vous déléguez le travail à un outil spécialisé : un "scraper". Ce robot est programmé pour reconnaître et isoler l'or, vous laissant au final avec un trésor de données prêtes à l'emploi.

Loin d'être une pratique obscure réservée aux développeurs, cette technologie est avant tout une solution stratégique. Son but est de libérer les équipes commerciales et marketing d'une des tâches les plus répétitives et à faible valeur ajoutée qui soit : la collecte manuelle d'informations.

Concrètement, comment fonctionne un scraper ?

Un robot de scraping, aussi appelé crawler ou spider, suit un processus en trois étapes pour "lire" une page web et en extraire les données qui vous sont utiles.

- Navigation : D'abord, le scraper se rend sur les pages web que vous lui indiquez. Il se comporte comme un navigateur, en suivant les liens, en passant d'une page à l'autre et en gérant même la pagination complexe d'un annuaire.

- Identification : Une fois sur la page, il repère les éléments que vous voulez extraire (noms, postes, entreprises, adresses e-mail...). Il se base sur la structure du code HTML, un peu comme notre œil sait distinguer un titre d'un paragraphe dans un article de journal.

- Extraction : Enfin, il copie ces informations et les structure proprement dans un fichier, comme un tableau Excel ou une base de données. Les données sont alors prêtes à être exploitées pour votre prospection.

Ce processus transforme un chaos de données non structurées, éparpillées sur le web, en une source d'informations claire et organisée. Pour voir comment des outils rendent cela accessible, vous pouvez découvrir le web scraping via des solutions comme Sheetly.

La finalité : une prospection plus intelligente

En B2B, l'objectif principal du scraping est de rendre la prospection plus ciblée et efficace. Au lieu de chercher des contacts au compte-gouttes, vous pouvez construire en un temps record des listes de prospects hautement qualifiés.

En automatisant la collecte, vous permettez à vos commerciaux de se concentrer sur leur véritable valeur ajoutée : créer des relations et vendre. Ce temps gagné se traduit directement par plus de contacts et, logiquement, plus d'opportunités commerciales.

Imaginons que vous souhaitiez cibler tous les directeurs marketing des entreprises de la French Tech qui sont en pleine phase de recrutement. Manuellement, cette tâche vous prendrait des jours. Avec le scraping, c'est une affaire de quelques minutes. Le résultat n'est pas juste une liste, c'est un véritable avantage stratégique sur vos concurrents.

Quelle méthode de scraping choisir ?

Toutes les approches de scraping ne se valent pas, loin de là. La bonne méthode dépend de trois choses : vos compétences techniques, le volume de données dont vous avez besoin, et la fréquence à laquelle vous devez les rafraîchir. C'est un peu comme choisir un véhicule : on ne prend pas une trottinette pour faire un déménagement.

Passons en revue les différentes options, de la plus simple à la plus sophistiquée, pour vous aider à trouver celle qui colle vraiment à vos ambitions commerciales.

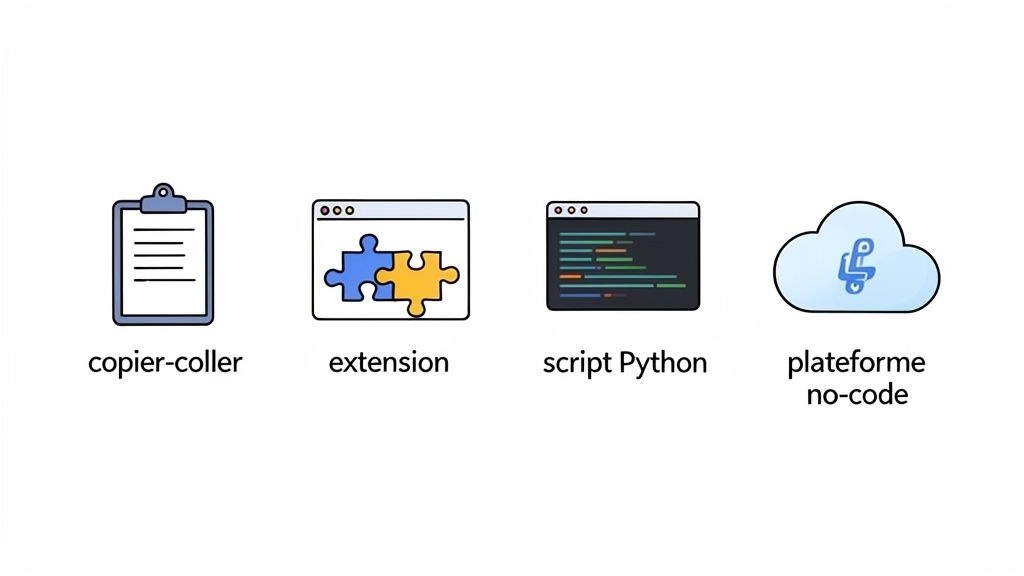

Le scraping manuel : la porte d'entrée

La forme la plus simple de scraping de données ? Le bon vieux copier-coller. On l'a tous fait : on repère une info sur une page web, on la surligne, on la copie, et on la colle dans un tableur.

Si cette technique a le mérite d'être accessible à tous, elle atteint très vite ses limites. C'est incroyablement lent et le risque d'erreur est énorme. C'est une solution viable pour récupérer une poignée de contacts, mais totalement inenvisageable pour bâtir une liste de prospection de plusieurs centaines de noms.

Les extensions de navigateur : pour les besoins ponctuels

Un cran au-dessus, on trouve les extensions de navigateur. Des outils comme Web Scraper s'intègrent directement dans Chrome ou Firefox et vous permettent de définir des règles d'extraction via une interface visuelle. En gros, vous cliquez sur les éléments qui vous intéressent, et l'extension se charge de reproduire l'opération sur d'autres pages similaires.

- Leur force : Très faciles à prendre en main, elles sont parfaites pour un projet ponctuel ou pour tester rapidement une idée sans écrire la moindre ligne de code.

- Leur faiblesse : Tout repose sur votre ordinateur. Vous fermez votre navigateur, le scraping s'arrête. Votre connexion internet flanche, le scraping s'arrête. Ce n'est donc pas la solution pour des extractions volumineuses ou régulières.

Les scripts personnalisés : la flexibilité absolue

Pour ceux qui parlent couramment le code, en particulier Python avec des bibliothèques comme BeautifulSoup ou Scrapy, la voie royale est de développer son propre script. Cela offre une liberté totale. Vous pouvez concevoir un scraper sur mesure pour n'importe quel site, gérer des logiques complexes et automatiser le tout sur un serveur dédié.

Mais cette puissance a un coût : elle exige de solides compétences techniques, du temps de développement et surtout, une maintenance constante. Le site cible change une virgule dans sa structure ? Votre script est cassé. Il faut alors le réparer, ce qui peut vite devenir un job à plein temps.

Le scraping de données reste une pratique largement sous-exploitée en France. En 2023, seulement 6 % des entreprises françaises de 10 salariés ou plus analysaient des données web, alors que la moyenne européenne s'élève à 9 %.

Ce chiffre, issu d'une enquête de l'INSEE, montre bien la marge de progression et l'opportunité qui s'offre aux entreprises qui s'équipent des bons outils.

Les plateformes SaaS no-code : la solution moderne

C'est là qu'intervient la dernière catégorie, celle qui change vraiment la donne pour les équipes commerciales et marketing : les plateformes SaaS no-code. Des outils comme Scraap.ai transforment ce qui était une tâche technique en un processus simple et visuel, entièrement géré dans le cloud.

Ces plateformes parviennent à réunir le meilleur des deux mondes. Elles offrent la simplicité d'une interface "clic-bouton" comme les extensions, tout en apportant la puissance et la fiabilité des scripts hébergés sur serveur.

Concrètement, voici comment elles simplifient tout :

- Aucun code nécessaire : Tout se fait via des menus et des actions visuelles. Le scraping devient enfin accessible à tous, pas seulement aux développeurs.

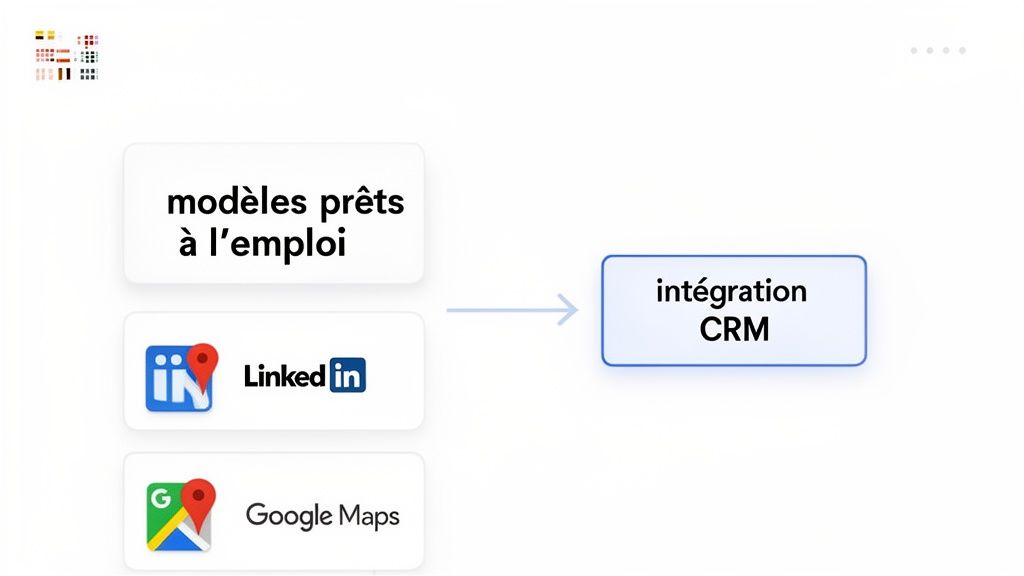

- Des modèles prêts à l'emploi : Elles proposent souvent des "recettes" préconfigurées pour les sources les plus populaires en B2B, comme LinkedIn ou les annuaires professionnels.

- Automatisation et passage à l'échelle : Les extractions tournent sur les serveurs de la plateforme, ce qui vous permet de collecter des milliers de données sans bloquer votre propre ordinateur. Vous pouvez même les programmer pour qu'elles se lancent toutes seules.

Pour une équipe de vente qui veut être efficace, c'est de loin l'approche la plus pertinente. Elle permet de se focaliser sur la stratégie et le message, pas sur la tuyauterie technique de la collecte de données. C'est un véritable avantage concurrentiel.

Mettre le turbo sur votre prospection : les cas d'usage qui changent la donne

Le scraping de données, ce n'est pas juste un truc de technicien. C'est un véritable levier stratégique pour bâtir une machine de prospection B2B qui anticipe les besoins de vos futurs clients. La théorie, c'est bien beau, mais c'est sur le terrain que la magie opère. L'idée est simple : passer d'une prospection subie, où l'on attend que le prospect se manifeste, à une approche proactive, entièrement guidée par les données.

Imaginez pouvoir repérer en quelques minutes les signaux faibles qui trahissent une opportunité commerciale sur le point de naître. C'est exactement ce que permet le scraping. On transforme le brouhaha incessant du web en listes de prospects ultra-qualifiées, prêtes à l'emploi.

Cibler les entreprises qui ont le vent en poupe

En B2B, l'un des signaux les plus révélateurs est le recrutement. Une entreprise qui se met à embaucher à tour de bras, surtout sur des postes clés (commerciaux, développeurs, marketeurs), c'est une boîte qui investit, qui a des projets plein les cartons et, donc, un budget à allouer.

Le scraping transforme cette information publique en une véritable mine d'or.

- Où chercher ? Sur les pages "Carrières" des entreprises de votre secteur, les gros sites d'offres d'emploi comme Indeed, ou bien sûr, la section "Emplois" de LinkedIn.

- Quoi récupérer ? Le nom de la société, le type de postes ouverts, le nombre de postes, et leur localisation.

- Et après ? Une fois cette liste d'entreprises en main, un second scraper peut aller chercher sur leur site ou sur LinkedIn les contacts pertinents. Vous vendez une solution RH ? Ciblez le DRH. Un logiciel pour les développeurs ? Visez le Directeur Technique.

Cette technique vous donne une longueur d'avance monumentale. Vous contactez ces entreprises au moment précis où elles expriment un besoin, bien avant que vos concurrents ne s'en rendent compte. Pour creuser le sujet, jetez un œil à notre guide sur le scraping de LinkedIn pour la prospection.

Identifier qui participe à un événement clé

Les salons, les conférences, les webinaires... ce sont des aimants à prospects qualifiés. Les participants sont là parce qu'un sujet précis les intéresse. La vraie question, c'est : comment entrer en contact avec eux avant, pendant, et surtout après l'événement ?

Le scraping permet de reconstituer la liste des participants ou, plus souvent, celle des exposants. En scannant la page web de l'événement, vous pouvez extraire les noms des entreprises présentes, les intervenants, et parfois même les listes d'inscrits (quand elles sont publiques). C'est une base de travail en or pour démarrer la conversation.

Prenons l'exemple d'un grand salon sur la cybersécurité. Vous pouvez commencer par extraire la liste complète des exposants. Dans un second temps, vous lancez un scraping sur les pages LinkedIn de chacune de ces entreprises pour y trouver les "Responsables Sécurité" ou les "DSI". Et voilà, vous avez une liste de contacts parfaitement dans votre cible.

Bâtir des listes de prospects "cousues main"

Là où le scraping brille vraiment, c'est dans sa capacité à créer des listes sur-mesure, d'une précision qu'aucune base de données achetée ne pourra jamais égaler.

Disons que vous vendez une solution de gestion de stock pour les PME industrielles en Auvergne-Rhône-Alpes.

- Étape 1 - La source : Visez des annuaires professionnels en ligne ou même Google Maps avec une recherche du type "PME industrielle Lyon".

- Étape 2 - L'extraction : Le scraper va récupérer les noms des entreprises, leurs adresses, et les URL de leurs sites web.

- Étape 3 - L'enrichissement : Un robot visite ensuite chaque site web pour trouver les pages "Contact" ou "À propos" et y dénicher les noms des dirigeants ou des responsables logistique.

En l'espace de quelques heures, vous avez entre les mains une liste de prospects que vous n'auriez jamais pu assembler manuellement. Et ces stratégies s'appliquent partout. Pour voir comment des approches similaires révolutionnent des secteurs entiers, lisez cet article sur l'impact de l'IA dans l'immobilier.

Pour vous donner une idée plus concrète, le tableau ci-dessous illustre quelques scénarios où le scraping permet de générer des listes de prospects hautement qualifiés.

Exemples de stratégies de scraping pour la prospection B2B

| Objectif de prospection | Source des données | Données à extraire | Impact commercial direct |

|---|---|---|---|

| Contacter les décideurs de startups qui viennent de lever des fonds. | Sites d'actualités tech (ex: Maddyness), Crunchbase. | Nom de l'entreprise, montant levé, secteur d'activité. | Ciblage précis d'entreprises avec un budget et des projets d'expansion. |

| Identifier les entreprises utilisant une technologie concurrente. | Annuaires de technologies (ex: BuiltWith) ou analyse du code source des sites. | Liste des sites web utilisant une technologie spécifique. | Prospection ciblée pour proposer une alternative plus performante ou économique. |

| Créer une base de restaurants pour une solution de réservation. | Google Maps, TripAdvisor, annuaires de restauration. | Nom, adresse, téléphone, site web, type de cuisine, notes des clients. | Génération rapide d'une liste exhaustive et géolocalisée pour les commerciaux. |

Ces exemples ne sont qu'un début. La véritable force du scraping de données, c'est sa flexibilité. Peu importe votre niche ou votre client idéal, il y a de fortes chances qu'une source de données publique en ligne n'attende que vous pour être exploitée et nourrir votre croissance.

Naviguer dans le scraping de données tout en respectant le RGPD

Le simple fait d'évoquer le scraping de données peut faire grincer quelques dents, surtout avec le spectre du Règlement Général sur la Protection des Données (RGPD) qui plane. C'est une réaction tout à fait compréhensible. Pourtant, il faut savoir une chose : le scraping, quand il est mené de manière éthique et responsable, a tout à fait sa place dans un cadre légal.

Mon but ici est de déconstruire les idées reçues et de vous montrer comment aborder ce sujet sereinement. L'idée est de transformer une source d'inquiétude potentielle en un véritable levier de croissance pour votre prospection B2B.

La différence cruciale : données personnelles vs professionnelles

Au cœur du sujet, il y a une distinction fondamentale à faire. Le RGPD a été créé pour une mission bien précise : protéger la vie privée des individus, c'est-à-dire leurs données personnelles. On parle ici d'une adresse de domicile, d'un numéro de téléphone privé ou d'opinions politiques.

Le scraping en B2B, celui qui nous intéresse, ne joue pas sur ce terrain-là. Son champ d'action, ce sont les informations professionnelles rendues publiques. Quand un directeur commercial affiche son poste et son entreprise sur LinkedIn, il le fait dans un contexte purement professionnel. Cette information, visible de tous, n'a rien à voir avec une donnée personnelle sensible.

Pensez au scraping B2B éthique comme à une collecte intelligente de cartes de visite numériques. Ce sont des informations que les professionnels laissent volontairement en vue pour développer leur réseau. Il ne s'agit pas d'espionnage, mais d'une collecte organisée de ce qui est déjà public.

C'est précisément dans ce cadre que des plateformes responsables comme Scraap.ai opèrent. Elles se concentrent uniquement sur les données que les professionnels choisissent de partager pour saisir des opportunités d'affaires.

Les 3 piliers d'un scraping conforme

Pour que votre démarche soit irréprochable, elle doit s'appuyer sur trois grands principes, directement inspirés par l'esprit du RGPD.

-

Une finalité légitime : La première question à se poser est "pourquoi ?". La prospection commerciale est reconnue comme un "intérêt légitime" pour une entreprise. Ce qui compte, c'est que votre approche soit pertinente pour la personne que vous contactez, et non intrusive.

-

La minimisation des données : Inutile de vouloir tout savoir. Ne collectez que ce qui est strictement nécessaire. Pour un premier contact, un nom, un prénom, un poste, le nom de l'entreprise et une adresse e-mail professionnelle suffisent amplement.

-

La transparence et le droit d'opposition : C'est la base du respect. Quand vous contactez un prospect, soyez transparent sur la façon dont vous avez obtenu ses coordonnées. Et surtout, offrez-lui toujours un moyen simple et visible de se désinscrire. C'est une obligation légale, oui, mais c'est aussi une marque de professionnalisme qui renforce votre image.

En appliquant ces règles, on passe d'une collecte de masse à l'aveugle à une approche quasi chirurgicale, ciblée et respectueuse.

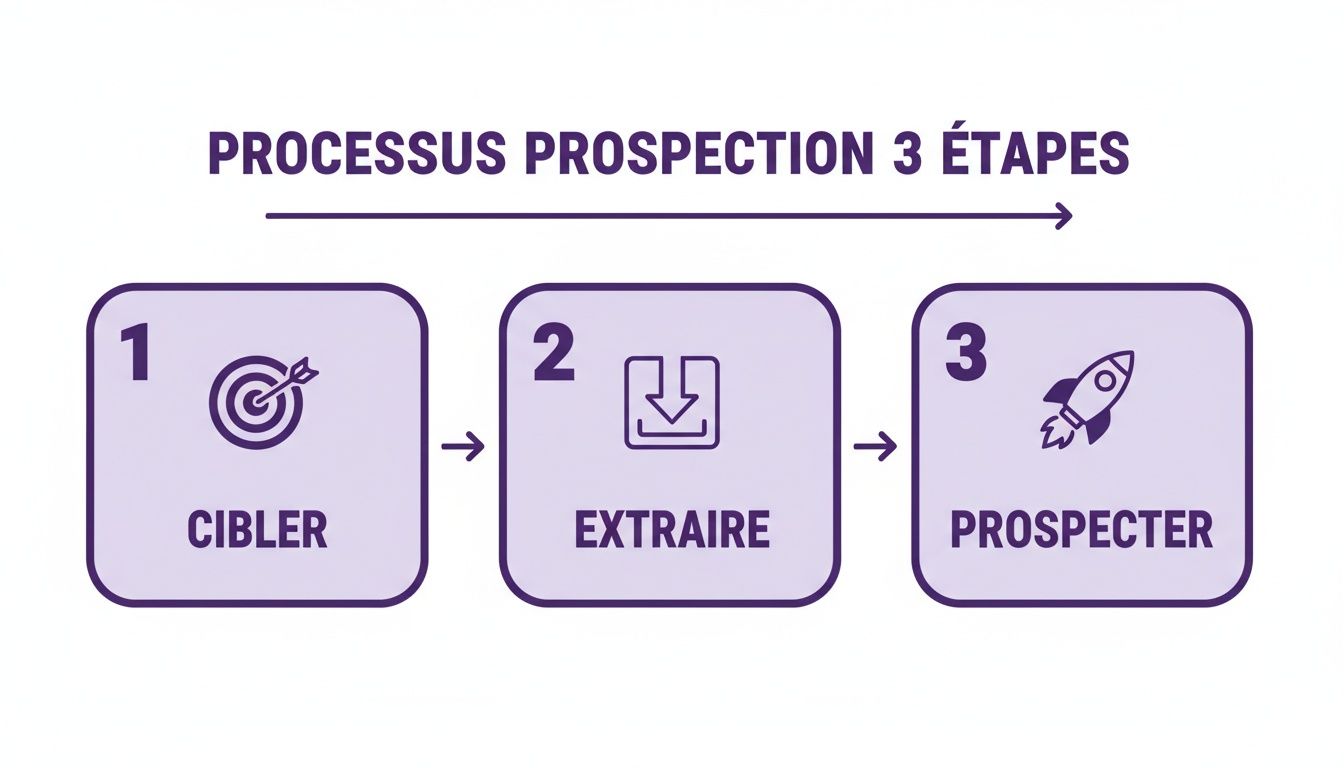

Ce processus peut être visualisé simplement : on cible, on extrait les informations pertinentes, puis on contacte la personne de manière appropriée.

Ce schéma montre bien que la collecte de données n'est qu'une étape du milieu, encadrée par une bonne stratégie de ciblage en amont et une approche de prospection respectueuse en aval.

Les bonnes pratiques pour une prospection en toute confiance

Au-delà des principes, quelques réflexes concrets permettent de sécuriser votre démarche. La première chose est de vous assurer que les outils que vous utilisez, comme Scraap.ai, ont été conçus avec la conformité au cœur de leur ADN.

Ensuite, privilégiez toujours la qualité à la quantité. Une liste de prospects plus courte mais ultra-qualifiée vous donnera de bien meilleurs résultats qu'une base de données gigantesque et peu pertinente, tout en limitant considérablement les risques.

Enfin, il est toujours bon de se familiariser avec la manière dont les données sont traitées. Pour vous faire une idée des clauses habituelles, vous pouvez lire une politique de confidentialité type qui explique comment les informations des utilisateurs sont gérées.

Pour conclure, le scraping de données en B2B n'est pas l'ennemi du RGPD. Loin de là. Mené avec intelligence, éthique et les bons outils, il devient un allié puissant pour développer votre activité de manière saine et durable, à mille lieues des pratiques de spam de masse.

Donnez un coup d'accélérateur à votre croissance avec les outils de scraping no-code

Fini le temps où le scraping de données était une affaire de spécialistes, un domaine réservé aux développeurs jonglant avec des scripts complexes. Aujourd'hui, une nouvelle génération d'outils est en train de rebattre les cartes, surtout pour les équipes commerciales et marketing qui n'ont ni le temps, ni les ressources pour se lancer dans des projets techniques.

Cette petite révolution a un nom : le no-code. Le concept est aussi simple que percutant : transformer des tâches autrefois techniques en processus visuels et intuitifs, accessibles à tous via des interfaces "clic-bouton". On oublie le code, on se concentre sur la stratégie.

La technologie ne devrait jamais être un obstacle, mais un tremplin. Les plateformes de scraping no-code incarnent parfaitement cette idée, en donnant aux équipes commerciales l'autonomie dont elles ont besoin pour piloter leur collecte de données et accélérer leur croissance.

C'est un véritable changement de paradigme. Au lieu de dépendre d'une équipe technique, un commercial peut désormais lancer lui-même une campagne de recherche de prospects en quelques heures à peine, contre plusieurs semaines auparavant. Une telle agilité devient un avantage concurrentiel majeur, qui permet de saisir les opportunités du marché presque en temps réel.

Les avantages concrets du scraping no-code

Les plateformes modernes comme Scraap.ai sont pensées comme des accélérateurs. Elles s'articulent autour de trois piliers essentiels pour toute équipe de vente qui cherche la performance.

-

Des interfaces visuelles et intuitives : Tout le processus se résume à cliquer sur les éléments qui vous intéressent sur une page web. Vous montrez à l'outil ce que vous voulez extraire, et il apprend à le faire à grande échelle. Pas besoin de connaître le HTML ou Python.

-

Des modèles prêts à l'emploi : Pourquoi réinventer la roue ? Ces outils proposent des "recettes" toutes prêtes pour les sources de données les plus recherchées en B2B : LinkedIn, Google Maps, les annuaires d'entreprises, etc. Il suffit de choisir un modèle, de le paramétrer et de lancer l'extraction.

-

Des intégrations natives avec vos outils : Une fois les données collectées, le plus important est de les utiliser. Les plateformes no-code se branchent directement à vos outils CRM (comme HubSpot ou Salesforce) et à vos logiciels de prospection. Les contacts extraits viennent ainsi nourrir vos campagnes sans aucune intervention manuelle.

Cet écosystème intégré change radicalement le quotidien. Pour aller plus loin, jetez un œil à notre guide complet sur comment le no-code scraping permet d'extraire des données web sans se faire bloquer.

Un océan de données à portée de clic

L'opportunité offerte par ces outils est immense, surtout quand on sait que l'activité en ligne n'a jamais été aussi forte. D'après le Baromètre du Numérique 2023, 82 % de la population française de 12 ans et plus se connecte chaque jour à internet, et 78 % utilise les réseaux sociaux.

Cette hyper-connectivité crée un terrain de jeu incroyablement riche pour le scraping de données B2B, où les informations professionnelles sont plus accessibles que jamais. Les outils no-code permettent à n'importe quelle entreprise, quelle que soit sa taille, de puiser dans cet océan de données pour affiner sa stratégie de prospection.

Comparaison rapide des approches

Pour bien saisir la valeur ajoutée, il suffit de comparer les différentes manières de faire du scraping.

| Critère | Script personnalisé (Python) | Plateforme no-code (SaaS) |

|---|---|---|

| Compétences requises | Élevées (développement, maintenance) | Faibles (logique métier, stratégie) |

| Temps de mise en place | Jours ou semaines | Quelques heures |

| Coût initial | Élevé (temps de développement) | Faible (abonnement mensuel) |

| Flexibilité | Totale, mais complexe | Guidée par des modèles, mais rapide |

| Maintenance | Continue (sites changent) | Gérée par la plateforme |

Ce tableau met en lumière un choix stratégique évident. Si le développement sur mesure garde son intérêt pour des besoins très spécifiques, l'approche no-code est de loin la plus efficace pour 95 % des besoins en prospection B2B. Elle offre le meilleur ratio puissance/effort, et permet aux équipes de se concentrer sur ce qu'elles font de mieux : vendre.

On répond à vos questions sur le scraping

Même avec toutes les cartes en main, il reste souvent quelques interrogations avant de plonger. C'est tout à fait normal. Démystifions ensemble les derniers points qui pourraient vous freiner.

Pourquoi ne pas simplement acheter une liste de contacts ?

C'est une excellente question, et elle touche au cœur de la différence entre une approche passive et une approche active de la prospection.

Acheter une liste, c'est un peu comme utiliser un annuaire imprimé l'année dernière. Une partie des informations est déjà périmée avant même que vous ne la receviez. Les gens changent de poste, d'entreprise, les boîtes mail sont supprimées... Bref, vous payez pour des données qui ont déjà commencé à se dégrader.

Le scraping, c'est l'exact opposé. Vous allez chercher l'information en temps réel, directement à la source. Vous ne récupérez que les données les plus fraîches et les plus pertinentes, celles qui sont publiques aujourd'hui.

En résumé : une liste achetée, c'est une photo jaunie. Le scraping, c'est un flux vidéo en direct. La différence en termes de qualité et de pertinence est énorme.

Avec des données fraîches, vous obtenez un meilleur taux de délivrabilité pour vos emails, vous menez des conversations plus justes et, au final, vos résultats commerciaux s'en ressentent directement.

Est-ce qu'on a vraiment le droit de scraper LinkedIn ?

C'est LA grande question qui agite beaucoup de monde. Clarifions les choses. Oui, les conditions d'utilisation de LinkedIn interdisent les méthodes de collecte automatisée. C'est leur droit en tant que plateforme.

Cependant, sur le plan légal, la situation est bien plus nuancée, surtout dans un cadre B2B. Plusieurs décisions de justice, notamment aux États-Unis, ont confirmé qu'on ne peut pas interdire la collecte d'informations qui sont publiquement accessibles. Si une info est visible par n'importe qui sans être connecté, elle est dans le domaine public.

Toute la clé réside dans une approche responsable et éthique. Un bon outil de scraping ne cherche pas à "pirater" LinkedIn. Au contraire, il se comporte comme un utilisateur humain particulièrement efficace, en respectant des limites pour ne jamais nuire à la plateforme.

- Il respecte des quotas raisonnables : Un scraping intelligent ne va jamais tenter d'aspirer des milliers de profils en une minute. Il mime un comportement humain.

- Il se concentre sur le public : On ne collecte que ce que tout le monde peut voir : nom, poste, entreprise... Rien de privé.

- Il sert une finalité légitime : La prospection commerciale B2B, lorsqu'elle est ciblée et non intrusive, est une finalité tout à fait reconnue.

En adoptant ces bonnes pratiques, on utilise l'immense potentiel de ces plateformes intelligemment, sans jamais tomber dans l'abus.

Comment faire pour que les données scrapées arrivent dans mon CRM ?

C'est le point crucial qui transforme un simple fichier en une machine à prospection. Une stratégie de scraping réussie ne s'arrête pas à la collecte ; elle doit s'intégrer sans la moindre friction dans vos outils du quotidien.

Heureusement, les plateformes no-code modernes comme Scraap.ai ont été pensées pour ça. Leur travail ne consiste pas juste à vous donner un fichier CSV à vous de vous débrouiller.

- Les données sont nettoyées et formatées pour vous : L'outil structure automatiquement les informations pour qu'elles correspondent aux champs de votre CRM (Prénom, Nom, Société, etc.). Fini les copier-coller fastidieux.

- Elles sont souvent enrichies : Avant même d'arriver chez vous, les profils peuvent être complétés avec des emails professionnels vérifiés ou d'autres données sur l'entreprise.

- L'intégration est directe : Les meilleures plateformes se connectent nativement à des CRM comme HubSpot, Salesforce ou Pipedrive. En quelques clics, vous mettez en place une règle simple : chaque nouveau prospect qualifié est automatiquement envoyé dans votre CRM, prêt à être contacté par vos équipes.

L'idée est de créer une autoroute de l'information, de la source web jusqu'à vos commerciaux, sans aucun péage manuel.

Quel budget faut-il prévoir pour se lancer ?

L'époque où le scraping était un projet coûteux, réservé aux entreprises capables de payer un développeur pendant des semaines, est révolue. L'arrivée des solutions no-code a complètement démocratisé l'accès à cette technologie.

Aujourd'hui, le modèle économique est bien plus souple. Les plateformes SaaS fonctionnent avec un abonnement mensuel, dont le prix dépend généralement de quelques facteurs :

- Le volume de données dont vous avez besoin.

- Le nombre de personnes dans votre équipe qui utiliseront l'outil.

- Les options avancées, comme l'enrichissement d'emails ou les intégrations CRM.

Les premiers forfaits démarrent souvent à quelques dizaines d'euros par mois, ce qui rend le scraping de données accessible même pour une startup ou un freelance. Il faut vraiment voir cet abonnement comme un investissement, pas comme un coût. Le temps gagné et la qualité des leads générés le rentabilisent très, très vite.

Prêt à alimenter votre prospection avec des données d'une fraîcheur inégalée ? Découvrez comment Scraap.ai peut automatiser votre génération de leads, sans que vous n'ayez à écrire la moindre ligne de code. Lancez-vous dès aujourd'hui sur https://www.scraap.ai/fr.