Penser à utiliser un scraper Google Maps, c'est bien plus qu'une simple astuce technique. C'est transformer la carte la plus connue au monde en votre propre base de données de prospection, vivante et sur-mesure. Concrètement, cette méthode vous permet de récupérer automatiquement des informations clés sur des milliers d'établissements locaux, transformant une recherche banale en une mine d'or de leads qualifiés.

Pourquoi scraper Google Maps peut tout changer pour vous

Imaginez un instant. Vous pourriez obtenir en quelques clics une liste complète de tous les restaurants italiens d'un arrondissement, avec leur site web, numéro de téléphone, et même leur note moyenne. C'est exactement ce que permet le scraping de Google Maps. L'idée n'est pas juste de collecter des contacts en vrac, mais de vraiment cartographier l'écosystème commercial d'une zone géographique avec une précision chirurgicale.

Cette approche ouvre des perspectives énormes pour de nombreux métiers. Une agence marketing peut, par exemple, identifier tous les commerces dont le site web est clairement à la traîne. Un fournisseur de matériel pour cafés et restaurants (CHR) peut, lui, dresser la liste de tous les nouveaux établissements qui viennent d'ouvrir. Les cas d'usage sont quasi infinis.

Pour bien comprendre la différence, j'ai résumé les deux approches dans un tableau. On voit vite où est l'intérêt.

Tableau : Scraping Manuel vs Automatisé sur Google Maps

Comparaison des deux approches pour illustrer rapidement les avantages d'un outil de scraping.

| Critère | Scraping Manuel (Copier-Coller) | Scraping Automatisé (Outil dédié) |

|---|---|---|

| Vitesse | Extrêmement lent, quelques dizaines de contacts par heure. | Très rapide, des milliers de contacts en quelques minutes. |

| Volume de données | Limité par la patience humaine, sujet aux erreurs. | Très élevé, peut extraire des villes ou régions entières. |

| Précision | Risque élevé d'erreurs de copie, d'oublis. | Fiabilité proche de 100 %, données structurées. |

| Richesse des infos | Basique (nom, adresse, tél), fastidieux d'aller plus loin. | Complet (avis, horaires, site web, coordonnées GPS...). |

| Coût | "Gratuit" en argent, mais extrêmement coûteux en temps de travail. | Coût d'abonnement à un outil, mais ROI rapide. |

Ce tableau le montre bien : si l'on est sérieux dans sa démarche de prospection, l'automatisation n'est pas une option, c'est une nécessité.

Les données que vous pouvez réellement exploiter

L'extraction de données depuis Google Maps va bien au-delà du simple duo nom-adresse. C'est une véritable mine d'informations commerciales prêtes à être utilisées :

-

Coordonnées directes : Numéros de téléphone, adresses physiques et bien sûr, les liens vers les sites web.

-

Réputation en ligne : La note moyenne et le nombre total d'avis, deux indicateurs en or pour juger de la satisfaction client.

-

Informations opérationnelles : Les horaires d'ouverture, les catégories précises comme "restaurant végétarien" ou "salon de coiffure bio".

-

Données géographiques : Les coordonnées GPS, parfaites pour des analyses de marché poussées ou pour optimiser les tournées d'un commercial.

Cette profondeur de données permet non seulement de bâtir des fichiers de prospection ultra-ciblés, mais aussi de mener de véritables études de marché. Et en France, le local, ça compte ! On estime que 50 % des internautes qui effectuent une recherche locale sur leur mobile se rendent dans un magasin le jour même. Mieux encore, 28 % de ces recherches débouchent sur un achat. Ces chiffres parlent d'eux-mêmes et montrent à quel point ces données sont stratégiques. Pour ceux qui veulent creuser le sujet, cette analyse sur le comportement des consommateurs est très éclairante.

Le scraping de Google Maps, ce n'est pas amasser de la data pour le plaisir. C'est obtenir de l'information ciblée pour prendre de meilleures décisions. C'est ce qui fait la différence entre une prospection à l'aveugle et une conversation pertinente avec le bon interlocuteur, au bon moment.

Au final, maîtriser un scraper Google Maps vous donne un avantage concurrentiel direct. Vous pouvez analyser la saturation d'un marché avant d'y lancer votre franchise, repérer les concurrents avec les pires avis pour leur proposer vos services, ou tout simplement vous constituer une base de prospects à jour et qualifiés. C'est un vrai accélérateur de croissance pour n'importe quelle entreprise qui vend à d'autres entreprises.

Choisir le bon outil pour votre scraping

Pour mettre la main sur les données de Google Maps, plusieurs chemins s'offrent à vous. Chacun a ses propres avantages et, bien sûr, ses contraintes. Le secret est de bien comprendre ces options pour choisir celle qui colle vraiment à vos ressources, votre budget et, surtout, à ce que vous voulez en faire au final.

Le monde du scraping peut faire un peu peur au premier abord, mais en réalité, tout se résume à trois grandes approches. Que vous soyez un développeur en quête de contrôle absolu ou une équipe commerciale qui veut juste des résultats rapides, il y a une solution pour vous.

L'approche "officielle" pour les développeurs : l'API Google Places

La première voie, c'est celle de l'API Google Places. C'est la porte d'entrée que Google met à disposition pour accéder à ses données de manière programmatique.

Son plus grand atout ? La fiabilité. Les données arrivent propres, parfaitement structurées, et la connexion est solide comme un roc. Mais attention, cette méthode a des inconvénients majeurs qui la rendent vite compliquée pour la prospection à grande échelle. Le coût, pour commencer, peut grimper en flèche, car Google vous facture à chaque appel.

Et puis il y a les quotas. L'API est assez stricte et ne renvoie qu'un maximum de 60 résultats par recherche. C'est très peu si votre objectif est de contacter des milliers de prospects. Pour couronner le tout, il faut de solides compétences techniques pour mettre tout ça en place et le maintenir.

La solution "maison" : les scripts de scraping personnalisés

La deuxième option consiste à retrousser ses manches et à développer son propre scraper Google Maps. En général, on utilise des langages comme Python avec des bibliothèques spécialisées comme Selenium ou Puppeteer.

Ici, la flexibilité est quasi totale. Vous pouvez paramétrer l'extraction pour ne récupérer que les champs qui vous intéressent, contourner certaines protections et intégrer votre script directement dans vos propres outils. C'est une solution extrêmement puissante, mais elle est clairement réservée aux profils techniques.

Créer et surtout maintenir un script comme celui-ci, c'est un vrai projet de développement. Il faut gérer la rotation des proxies pour ne pas se faire bloquer son adresse IP, adapter le code dès que Google Maps change la moindre petite chose sur sa page, et s'assurer que tout reste stable. C'est un travail à temps plein.

En prospection, la vitesse et la simplicité sont les nerfs de la guerre. Une solution qui prend des semaines à développer juste pour sortir une liste de contacts est rarement rentable, même si elle offre un contrôle total.

L'approche la plus directe : les outils no-code

Et enfin, la troisième voie, de loin la plus accessible pour les équipes commerciales et marketing : les outils no-code spécialisés comme Scraap.ai. Ces plateformes ont été pensées pour rendre le scraping de données aussi simple qu'une recherche sur Google.

Leur avantage numéro un, c'est la prise en main immédiate. Pas une seule ligne de code à écrire. Vous entrez votre mot-clé ("restaurants", "plombiers"...), votre ville, et l'outil s'occupe de toute la machinerie complexe en arrière-plan.

Ces solutions embarquent des fonctionnalités qui seraient un vrai casse-tête à gérer soi-même :

-

Gestion des proxies intégrée : L'outil jongle automatiquement avec un immense réseau de proxies pour passer sous les radars et garantir une extraction complète.

-

Enrichissement automatique : Au-delà des infos de base, beaucoup d'outils (dont Scraap.ai) vont plus loin. Ils visitent les sites web des entreprises trouvées pour dénicher des adresses email, une information cruciale qui n'est jamais disponible sur Google Maps.

-

Interface claire : Les résultats sont livrés sur un plateau, dans un tableau propre et prêt à être exporté en CSV ou Excel pour une intégration directe dans votre CRM.

Si vous voulez avoir une vue d'ensemble du marché, je vous conseille de jeter un œil à notre comparatif sur les meilleurs outils d'extraction web pour automatiser le scraping.

Pour vous aider à visualiser tout ça, voici un tableau qui résume les points clés de chaque méthode.

Comparatif des Méthodes de Scraping Google Maps

Ce tableau comparatif est là pour vous aider à y voir plus clair et à choisir la méthode qui correspond le mieux à votre profil technique, votre budget et vos objectifs.

| Méthode | Niveau Technique Requis | Coût Estimé | Vitesse d'Extraction | Idéal Pour |

|---|---|---|---|---|

| API Google Places | Élevé (Développeur) | Variable à élevé (paiement à l'usage) | Limitée par les quotas | Les intégrations spécifiques dans des applications. |

| Script Python | Très Élevé (Développeur expérimenté) | Faible (serveur/proxies) mais élevé en temps | Variable (dépend du code) | Les besoins de scraping très pointus et uniques. |

| Outil No-Code | Très Faible (Aucun code) | Faible à moyen (abonnement mensuel) | Très élevée | Les équipes Sales, Marketing et Growth. |

Pour résumer, si votre but est de construire rapidement des listes de prospects qualifiés sans vous noyer dans la technique, un outil no-code est sans l'ombre d'un doute la solution la plus efficace. Il rend l'accès à ces données précieuses possible pour tout le monde, permettant à n'importe qui de monter une machine de prospection qui tourne.

Lancer votre première extraction de données

Bon, passons aux choses sérieuses. L'idée de "scraper" Google Maps peut faire un peu peur au premier abord, on imagine tout de suite des lignes de code complexes. En réalité, avec les bons outils, c'est presque aussi simple que de faire une recherche classique. On va prendre Scraap.ai comme exemple pour vous montrer concrètement comment transformer une simple idée en une liste de prospects qualifiés, et ce, en quelques minutes.

La première étape, et honnêtement la plus cruciale, c'est de bien définir ce que vous cherchez. C'est là que tout se joue. Une recherche trop vague comme "restaurant" va vous noyer sous des milliers de résultats, la plupart inutiles. L'objectif est d'être chirurgical pour ne remonter que la crème de la crème.

La clé : formuler des requêtes qui tapent dans le mille

Le secret d'une extraction réussie, c'est la qualité du ciblage. Mettez-vous à la place de votre client idéal : qu'est-ce qu'il taperait dans la barre de recherche de Google ? Oubliez les termes génériques et privilégiez des combinaisons qui dessinent un portrait-robot précis de votre cible.

Quelques exemples pour que ce soit plus parlant :

-

À éviter : "garage"

-

Bien mieux : "garage spécialiste BMW Lyon 6"

-

À éviter : "agence"

-

Bien mieux : "agence immobilière de luxe Paris 16"

-

À éviter : "boulangerie"

-

Bien mieux : "boulangerie artisanale sans gluten Bordeaux"

En affinant la recherche de cette manière, vous faites le tri avant même de commencer. Chaque contact que vous extrairez aura bien plus de chances de correspondre à votre profil client idéal.

Un petit conseil d'expérience : la qualité de votre liste finale est directement liée à la précision de votre recherche initiale. Prenez cinq minutes pour bien y réfléchir, ça vous fera gagner des heures de tri plus tard.

Une fois que votre requête est lancée, l'outil prend le relais. Il va scanner Google Maps, récupérer les infos et les organiser proprement pour vous. C'est toute la beauté des solutions no-code.

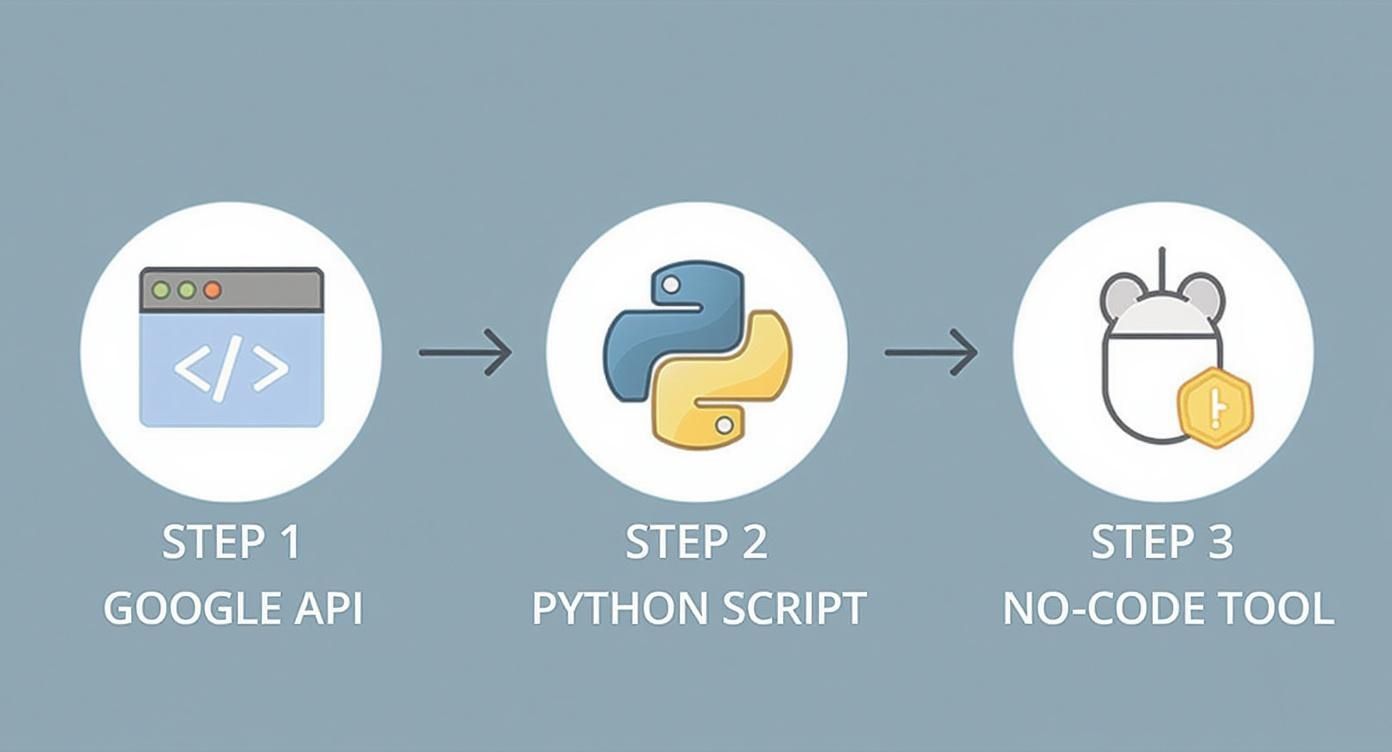

Avant d'aller plus loin, il est utile de visualiser les différentes manières de s'y prendre. Cette infographie résume bien les trois grandes approches : passer par l'API officielle, développer son propre script, ou utiliser un outil no-code.

On le voit bien, pour une équipe commerciale ou marketing sans développeur sous la main, la voie du no-code est de loin la plus directe et la plus pragmatique.

Concrètement, qu'est-ce qu'on récupère ?

Après quelques instants, le travail est fait. Vous vous retrouvez avec un tableau bien propre, prêt à être exploité. Voici le genre d'informations qu'un bon scraper Google Maps va vous fournir :

-

Nom de l'entreprise : Le nom commercial, tout simplement.

-

Adresse complète : Rue, ville, code postal, pays.

-

Numéro de téléphone : Le contact direct, essentiel.

-

Site web : La porte d'entrée pour aller chercher plus d'infos.

-

Note moyenne : Un excellent indicateur de la réputation.

-

Nombre d'avis : Pour évaluer la notoriété et l'ancienneté.

-

Catégorie : L'activité précise (ex : "restaurant italien", "plombier").

Cette base de données brute est déjà une petite pépite. Vous pouvez l'exporter en CSV ou Excel et commencer votre prospection. L'atout majeur de ces données, c'est leur fiabilité. On estime que d'ici 2025, 86 % des utilisateurs français se serviront de Google Maps pour trouver des commerces locaux. Cette adoption massive fait de la plateforme un miroir quasi parfait du tissu économique local. Pour en savoir plus, vous pouvez consulter ces statistiques sur l'usage de Google en France.

La mécanique invisible qui vous simplifie la vie

Pendant que vous configuriez votre recherche, en coulisses, l'outil a géré toute la partie technique. Le principal défi du scraping, c'est de ne pas se faire repérer et bloquer par Google, qui n'aime pas trop les robots qui aspirent ses données en masse.

Pour y parvenir, des plateformes comme Scraap.ai s'appuient sur un système de rotation de proxies. C'est assez malin : imaginez que l'outil possède un trousseau avec des milliers d'adresses IP différentes. Pour chaque page qu'il analyse, il change d'IP. Vu de l'extérieur, cela ressemble au trafic de milliers de personnes différentes, ce qui rend la détection quasiment impossible et assure que votre extraction aille jusqu'au bout, même si vous demandez des milliers de résultats.

En plus, ces plateformes sont constamment mises à jour par leurs équipes pour s'adapter au moindre changement dans la structure de Google Maps. Vous n'avez donc pas à vous soucier de la maintenance technique.

Quelques astuces pour aller plus loin

Maintenant que vous avez les bases, voici quelques conseils tirés du terrain pour optimiser vos campagnes :

-

Croisez les mots-clés : Pour ratisser un secteur d'activité complet, ne vous contentez pas d'un seul terme. Lancez des extractions séparées ("agence de communication", "agence digitale", "agence marketing"), puis fusionnez les fichiers en supprimant les doublons.

-

Automatisez la veille : Le paysage commercial évolue sans cesse. Planifiez une extraction mensuelle ou trimestrielle sur vos zones géographiques clés pour repérer les nouveaux arrivants et mettre vos listes à jour.

-

Soyez hyper-spécifique : Au lieu de "restaurant", testez "restaurant de fruits de mer", "pizzeria à emporter" ou "bistrot français traditionnel". Plus votre angle est précis, plus votre message de prospection sera pertinent et percutant.

Avec ces techniques en main, vous êtes paré pour lancer votre première campagne et construire une liste de prospects vraiment qualifiés. La prochaine étape sera d'enrichir ces données brutes pour les transformer en véritables opportunités commerciales.

Transformez vos données brutes en leads qualifiés

Vous avez terminé votre extraction, vous avez une liste de contacts. C'est un excellent point de départ, mais pour l'instant, ce n'est que de la matière première. La vraie magie, celle qui transforme cette simple liste en un pipeline de ventes solide, se passe après l'extraction : c'est l'étape de l'enrichissement et de la qualification.

C'est là que le travail prend toute sa valeur. Des informations basiques comme le nom et l'adresse sont utiles, bien sûr, mais pour engager une conversation pertinente, il faut creuser un peu plus.

De la donnée brute à la donnée intelligente

L'enrichissement, c'est tout simplement le fait de compléter votre fichier avec des informations cruciales qui ne sont pas visibles directement sur Google Maps. Le plus évident ? Trouver les adresses email professionnelles. Un bon outil de scraper Google Maps ne se contente pas d'aspirer les fiches ; il va aussi visiter les sites web des entreprises pour y dénicher des contacts.

Ensuite, vient une étape essentielle : la validation. Avoir un email ou un numéro de téléphone, c'est bien. Être sûr qu'ils fonctionnent, c'est beaucoup mieux. Des systèmes de vérification permettent de "nettoyer" vos listes, d'éliminer les contacts obsolètes et d'améliorer drastiquement la délivrabilité de vos campagnes. C'est aussi un excellent moyen de protéger votre réputation d'expéditeur.

Mettez en place un système de scoring de leads

Le scoring de leads, c'est votre boussole. L'idée est d'attribuer une note à chaque prospect pour savoir où concentrer vos efforts. Et la bonne nouvelle, c'est qu'avec les données que vous venez de récupérer, vous avez déjà tout ce qu'il vous faut pour commencer.

Voici quelques indicateurs simples, mais redoutablement efficaces, à intégrer dans votre modèle :

-

Note moyenne et nombre d'avis : Une entreprise avec 4.7 étoiles et plus de 200 avis est probablement bien implantée et attentive à son image. À l'inverse, une fiche à 3.2 étoiles avec 15 avis peut être une cible de choix pour une agence spécialisée en e-réputation.

-

Présence d'un site web : L'absence de site est un signal fort pour une agence web. Un site existant mais non sécurisé (HTTP) représente une autre belle opportunité.

-

Catégorie d'activité précise : Ne vous arrêtez pas à "restaurant". Affinez votre ciblage avec "restaurant italien", "pizzeria" ou "bistrot" pour personnaliser votre approche au maximum.

Le scoring change complètement la donne. Au lieu de tirer à l'aveugle, vous concentrez 80 % de votre énergie sur les 20 % de prospects les plus prometteurs. On passe d'une prospection de volume à une prospection de valeur.

Ce système de notation n'est pas juste un concept. Il est directement actionnable. En triant votre fichier par score, vos commerciaux savent exactement par qui commencer leur journée.

Croisez les données pour une qualification avancée

La véritable puissance se déchaîne quand vous commencez à croiser vos données Google Maps avec d'autres sources, notamment firmographiques. C'est comme ça que vous construisez un profil client idéal (ICP) d'une richesse inégalée.

Imaginez pouvoir filtrer votre liste non seulement par lieu et par note, mais aussi par :

-

Taille de l'entreprise (effectif) : Pour adapter votre discours aux TPE, PME ou aux plus grands comptes.

-

Technologies web utilisées : Savoir qu'une entreprise utilise une technologie concurrente à la vôtre (comme Shopify, PrestaShop ou WordPress) est une information qui vaut de l'or.

-

Signaux d'affaires : Détecter une entreprise qui recrute activement peut signaler une phase de croissance et donc de nouveaux besoins.

Cette approche multicouche transforme un simple fichier en une base de données stratégique. Pour ceux qui veulent aller plus loin, nous avons d'ailleurs un article qui explique comment utiliser les outils d'IA pour générer des leads qualifiés, ce qui s'inscrit parfaitement dans cette logique.

N'oubliez jamais la valeur des avis. Une étude a montré que plus de 90 % des utilisateurs font confiance aux avis qu'ils lisent sur Google Maps. Cette statistique montre à quel point la note et les commentaires sont un baromètre fiable de la réputation d'une entreprise. Intégrer cet aspect dans votre scoring vous donne une base de qualification solide et tangible.

En combinant une extraction propre, un enrichissement pertinent et un scoring intelligent, vous ne faites plus que collecter des contacts. Vous bâtissez une véritable machine de prospection, prête à fournir à vos équipes commerciales des leads qualifiés, pertinents et déjà priorisés.

Utiliser vos données en toute conformité

Le scraping, c’est fait. Vous vous retrouvez avec une montagne de données brutes, une véritable mine d'or potentielle. Mais c'est maintenant que le vrai travail commence : transformer cette matière première en leads qualifiés, tout en restant parfaitement dans les clous sur le plan légal.

Cette phase finale repose sur deux piliers. D'un côté, l'aspect technique : comment intégrer proprement ces nouvelles informations dans vos outils, comme votre CRM. De l'autre, et c'est non négociable, le respect scrupuleux des réglementations, notamment le RGPD, pour construire une prospection saine et durable.

Intégrer vos listes de prospects dans votre CRM

Votre extraction vous a probablement laissé avec un fichier CSV ou Excel bien rempli. C'est votre passerelle vers votre CRM. Le but du jeu est simple : injecter ces nouveaux contacts sans semer le chaos dans votre base existante.

Que vous soyez sur HubSpot, Salesforce, Pipedrive ou un autre outil, la mécanique d'import est souvent la même. Le secret d'une opération réussie tient en deux mots : mappage des champs. Il s'agit tout simplement d'indiquer à votre CRM que la colonne "Nom de l'entreprise" de votre fichier doit aller dans le champ "Nom de l'entreprise" du CRM, et ainsi de suite.

Quelques conseils tirés du terrain pour éviter les maux de tête :

-

Nettoyez avant d'importer. Un grand classique. Assurez-vous que les numéros de téléphone ont un format unifié et que les noms d'entreprises sont propres. C'est la meilleure arme contre les doublons.

-

Soyez méticuleux sur le mappage. Prenez cinq minutes pour vérifier que chaque colonne correspond au bon champ. Une erreur d'inattention, et vous vous retrouvez avec un site web dans le champ "adresse". La donnée devient alors complètement inutile.

-

Pensez à l'identifiant unique. Si vous le pouvez, utilisez le site web de l'entreprise comme identifiant unique. Cela vous sauvera la vie lors des prochains imports pour éviter de recréer des contacts qui existent déjà.

Une intégration bien menée, c'est la garantie que vos commerciaux pourront se jeter sur ces nouveaux leads sans perdre une minute. Si vous voulez creuser le sujet, notre guide sur la création d'une base de données de prospection efficace aborde ces points en profondeur.

Une base de données bien organisée, c'est le moteur de votre prospection. L'import n'est pas une simple étape technique ; c'est le moment où vous donnez vie à vos données en les rendant exploitables par vos équipes.

Naviguer dans le cadre légal du RGPD

Venons-en au sujet qui crispe souvent : la conformité. Soyons clairs, utiliser les données de Google Maps pour de la prospection B2B est tout à fait possible, à condition de bien connaître les règles.

La bonne nouvelle, c'est que le RGPD a été conçu pour protéger les données à caractère personnel. Les informations qui concernent une personne morale – une entreprise – comme son nom, son adresse postale ou son numéro de téléphone standard, ne sont globalement pas concernées.

La distinction clé : données d'entreprise vs données personnelles

C'est vraiment la nuance à maîtriser pour travailler sereinement.

-

Données d'entreprise (Personne Morale) :

-

De quoi on parle ? Le nom de la société, l'adresse du siège, le numéro du standard (ex: 01 23 45 67 89), ou une adresse email générique (type [email protected]).

-

La règle ? Ces données ne sont pas considérées comme personnelles. Vous pouvez donc les collecter et les utiliser pour une prospection B2B, du moment que votre offre est pertinente pour l'entreprise que vous visez.

-

-

Données à caractère personnel :

-

De quoi on parle ? Une adresse email nominative, du type [email protected].

-

La règle ? Là, on entre dans le champ du RGPD. Pour les utiliser, il faut une base légale (souvent "l'intérêt légitime" en B2B) et surtout, respecter les droits des individus (droit d'information, d'opposition...).

-

Concrètement, ça veut dire quoi ? Vous pouvez appeler une entreprise sur son numéro de standard ou lui envoyer un email sur son adresse "contact@" sans vous poser trop de questions. En revanche, si vous avez un email nominatif, votre approche doit être plus fine.

Pour une prospection par email sur une adresse nominative, voici les bonnes pratiques à suivre à la lettre :

-

Pertinence avant tout. Votre produit ou service doit avoir un lien logique et direct avec la fonction de votre interlocuteur.

-

Jouez la transparence. Indiquez d'où viennent les données et pourquoi vous le contactez.

-

Facilitez la sortie. Un lien de désinscription simple, visible et qui fonctionne en un clic est absolument obligatoire dans toutes vos communications.

En respectant ces principes, vous ne faites pas que respecter la loi. Vous menez une prospection plus intelligente, plus respectueuse, et vous posez les bases d'une relation de confiance dès le premier contact. Et c'est bien ça, le but final.

Les questions que vous vous posez sur le scraping de Google Maps

Même avec le meilleur des guides, il reste souvent quelques questions bien concrètes. C'est tout à fait normal. J'ai regroupé ici les interrogations les plus fréquentes pour y répondre sans détour, en me basant sur mon expérience, pour que vous puissiez vous lancer l'esprit tranquille.

On va parler légalité, risques techniques, volume de données et de l'incontournable question des proxies. L'idée, c'est de vous donner des réponses claires et pratiques pour que vous démarriez votre prospection sur des bases saines.

Est-ce que scraper Google Maps est légal ?

C'est LA grande question, et la réponse est plus simple qu'on ne le pense, surtout pour la prospection B2B. En France, la collecte de données publiques sur des entreprises (personnes morales) comme leur nom, leur adresse ou le numéro de leur standard est généralement autorisée. Ce ne sont pas des données personnelles.

Là où il faut être vigilant, c'est avec les données qui permettent d'identifier une personne, comme une adresse e-mail du type pré[email protected]. Ces informations tombent sous le coup du RGPD.

Pour rester dans les clous, il y a deux règles d'or à suivre :

-

Pertinence : Votre offre doit avoir un lien direct et logique avec l'activité de l'entreprise que vous contactez.

-

Respect : Vous devez systématiquement offrir un moyen simple et immédiat de se désinscrire de vos communications.

Le secret, ce n'est pas tant la collecte que l'usage que vous en faites. Une approche éthique, où votre message apporte une vraie valeur, est non seulement conforme à la loi, mais aussi beaucoup plus payante commercialement.

Quels sont les vrais risques du scraping sur Google Maps ?

Le principal risque n'est pas tant juridique que technique. Google met le paquet pour protéger ses données avec des mécanismes anti-robots très performants. Pensez aux CAPTCHAs incessants ou au blocage pur et simple des adresses IP qui ont un comportement suspect.

Si vous tentez l'aventure avec un script fait maison ou en copiant-collant à la main, l'échec est quasiment garanti. Votre adresse IP sera très vite repérée et bannie, et votre collecte s'arrêtera net.

C'est précisément là que les outils professionnels changent la donne. Ils sont conçus pour naviguer à travers ces défenses. Comment ? En utilisant un large réseau de proxies rotatifs de haute qualité. En changeant d'IP à chaque requête, ils imitent le comportement de milliers d'utilisateurs humains, ce qui rend la détection quasi impossible et garantit une extraction fluide et complète.

Un autre point à ne pas négliger est la fraîcheur des données. Google Maps est une source incroyable, mais une petite vérification après l'extraction, notamment pour les e-mails et les numéros de téléphone, est une bonne pratique pour s'assurer de la qualité de ses listes.

Combien de prospects peut-on vraiment extraire ?

Tout dépend de la précision de votre recherche. Une requête très large comme "restaurant à Paris" peut théoriquement retourner des milliers de résultats. À l'inverse, une recherche de niche comme "notaire spécialisé en droit des sociétés à Limoges" ne vous en donnera qu'une poignée.

Les outils no-code sont bâtis pour gérer de gros volumes et peuvent extraire des milliers de fiches sans problème. Mais attention à ne pas tomber dans le piège de la quantité au détriment de la qualité.

Mon conseil d'expert : adoptez une stratégie de "micro-ciblage". Il est infiniment plus efficace de lancer plusieurs petites recherches très ciblées qu'une seule énorme requête générique. Par exemple, au lieu de chercher "agence de communication Lyon", segmentez :

-

"Agence SEO Lyon"

-

"Agence social media Lyon"

-

"Agence de branding Lyon"

Cette méthode vous permet de constituer des listes de prospects bien plus qualifiés. Votre message sera d'autant plus pertinent et votre taux de conversion s'envolera. La qualité du ciblage est la pierre angulaire de toute campagne réussie.

Les proxies, c'est vraiment indispensable ?

La réponse est oui, sans la moindre hésitation. C'est non négociable dès que vous voulez extraire plus d'une dizaine de résultats. Sans un bon système de proxies, votre tentative de scraping sera un feu de paille. Votre adresse IP sera immédiatement identifiée comme suspecte par Google et bloquée.

Le confort des solutions SaaS comme Scraap.ai réside justement dans le fait qu'elles gèrent toute cette complexité pour vous, en toute transparence. Pas besoin d'acheter, de configurer ou de maintenir un parc de proxies. La plateforme s'occupe de tout en coulisses, en faisant tourner des milliers d'adresses IP résidentielles et de datacenters.

Cela vous garantit non seulement que votre extraction ira jusqu'au bout, mais aussi qu'elle se fera à une vitesse optimale. Vous obtenez ainsi des listes complètes en quelques minutes à peine.

Prêt à faire de Google Maps votre machine à leads ? Avec Scraap.ai, lancez votre première extraction en moins de 5 minutes, sans aucune compétence technique, et commencez à construire des listes de prospection ultra-qualifiées dès aujourd'hui. Essayez Scraap.ai gratuitement.