Scraper Google Maps, c'est tout simplement l'art d'extraire automatiquement les informations publiques des fiches d'entreprises – nom, adresse, téléphone, site web – pour se constituer des listes de prospects. C'est une méthode redoutable pour booster sa prospection B2B et ses analyses de marché, en transformant les données visibles sur la carte en un fichier exploitable.

Pourquoi le scraping de Google Maps change les règles du jeu en prospection B2B

On a tous l'habitude de voir Google Maps comme un simple outil de navigation. Pourtant, c'est bien plus que ça. C'est devenu une base de données commerciales vivante, presque exhaustive, une véritable mine d'or pour n'importe quelle équipe de vente qui cherche de nouvelles opportunités. Chaque fiche d'établissement est une porte d'entrée vers un client potentiel.

Le secret de sa puissance, c'est sa popularité écrasante. Avec plus d'un milliard d'utilisateurs actifs chaque mois dans le monde, son adoption est colossale. En France, le chiffre est encore plus parlant : 86 % des internautes l'utilisent pour rechercher des entreprises locales. Autant dire que c'est un miroir assez fidèle du tissu économique réel. Si vous voulez creuser le sujet, jetez un œil à ces statistiques clés sur Google en France.

Libérer un potentiel commercial insoupçonné

Scraper Google Maps, c'est transformer cette montagne d'informations en un véritable avantage concurrentiel. Fini le temps perdu à copier-coller manuellement les infos d'une poignée d'entreprises. On parle ici d'automatiser la collecte de milliers de contacts en quelques minutes seulement.

Imaginez un instant pouvoir générer la liste de tous les restaurants d'une ville qui n'ont pas de site web. Ou encore, identifier toutes les agences immobilières d'un département avec une note moyenne inférieure à 3,5 étoiles. Ce niveau de précision était, il n'y a pas si longtemps, l'apanage des entreprises avec de gros budgets pour des bases de données hors de prix.

On passe d'une recherche manuelle, lente et fastidieuse, à un véritable processus stratégique. On ne cherche plus des contacts un par un, on construit des segments de marché entiers, prêts à être activés.

Des cas d'usage très concrets pour la croissance

Les données que vous extrayez viennent nourrir directement votre pipeline commercial et vos actions marketing. Voici quelques exemples très concrets :

- Créer des listes de prospection ultra-ciblées : Filtrez par secteur d'activité, zone géographique, avis clients, ou même par l'absence d'un site internet. Idéal pour lancer des campagnes d'e-mailing ou de phoning qui tapent dans le mille.

- Analyser la concurrence locale : Cartographiez la présence de vos concurrents, décortiquez leurs avis clients pour trouver leurs points faibles, et repérez les zones géographiques qu'ils ont délaissées.

- Enrichir votre CRM : Complétez les fiches de vos prospects actuels avec des données géographiques fraîches et des avis récents pour personnaliser encore plus votre approche.

Ce guide va vous montrer comment maîtriser cette compétence, en abordant les aspects techniques comme les points légaux à connaître, pour faire de Google Maps votre meilleur allié commercial.

Quelle méthode choisir pour extraire les données de Google Maps ?

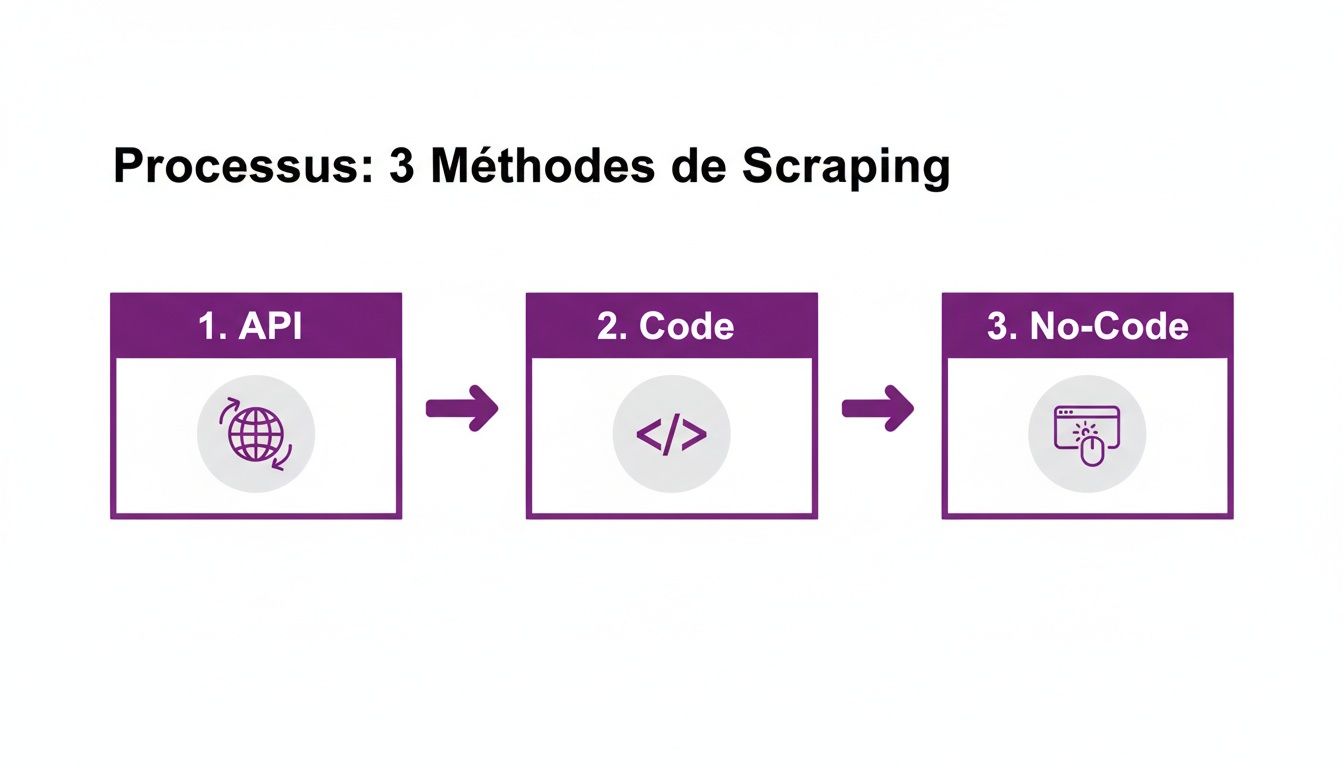

Quand il s'agit de scraper Google Maps, il n'y a pas de solution miracle. Le bon choix va vraiment dépendre de votre aisance technique, de votre budget et, soyons honnêtes, du temps que vous pouvez y consacrer. Passons en revue les trois grandes options pour que vous puissiez décider laquelle est la plus adaptée à votre projet de prospection.

Chaque approche a ses propres règles du jeu. L'API officielle de Google est la voie "royale" mais limitée. Le code maison vous donne une liberté totale, mais demande de sérieuses compétences techniques. Enfin, les outils no-code ouvrent le jeu à tout le monde, en particulier aux équipes commerciales.

1. Passer par l'API officielle de Google Maps Platform

La première option, la plus "propre" sur le papier, c'est d'utiliser l'API Places que Google met à disposition. C'est la méthode officielle, donc 100% conforme à leurs règles. Elle a l'avantage d'être fiable, stable et de vous fournir des données bien structurées, prêtes à l'emploi.

Seulement voilà, cette fiabilité a un prix et des contraintes. L'API est bridée et ne retourne qu'un maximum de 60 résultats par recherche. Pour une prospection à grande échelle, c'est très léger. Et même si Google offre un crédit mensuel, la facture peut vite grimper si vos besoins dépassent ce quota. C'est une bonne piste pour des besoins très ponctuels, mais rarement pour construire des listes de milliers de prospects.

L'interface est clairement pensée pour les développeurs, pas pour un commercial qui veut simplement une liste d'entreprises.

2. Développer son propre scraper en Python

Pour les profils techniques, mettre les mains dans le code et monter son propre scraper en Python est une option très puissante. Avec des bibliothèques comme Selenium ou Playwright, on peut piloter un navigateur web pour imiter un utilisateur. Ensuite, on utilise Beautiful Soup pour fouiller dans le code HTML de la page et en extraire les pépites d'information.

L'avantage, c'est une flexibilité quasi totale. Vous ciblez exactement les données qui vous intéressent, vous adaptez le script quand Google Maps change son design, et vous pouvez l'intégrer dans des workflows plus complexes. C'est du sur-mesure.

Le vrai défi avec un scraper maison, ce n'est pas d'écrire la première version du code. C'est de le maintenir en vie. Google met constamment à jour sa structure et ses protections, ce qui vous oblige à ajuster votre script régulièrement pour qu'il ne casse pas.

Et c'est là que les choses se corsent. Pour scraper sans se faire bloquer, il faut très vite investir dans un arsenal technique :

- Des proxies rotatifs : Pour changer d'adresse IP à chaque requête et ne pas se faire bannir.

- Un service de résolution de CAPTCHAs : Pour passer les tests de sécurité "Je ne suis pas un robot".

- Une simulation de comportement humain : Introduire des pauses aléatoires, varier les clics... Bref, ne pas avoir l'air d'un bot.

Cette approche demande donc non seulement un bon bagage technique, mais aussi un budget pour l'infrastructure et, surtout, du temps pour la maintenance.

3. Utiliser un outil no-code spécialisé

La troisième voie, c'est celle des plateformes de scraping no-code. Ces outils ont été pensés pour les équipes commerciales et marketing qui n'ont ni le temps, ni l'envie, ni les compétences pour coder leur propre solution. L'idée est simple : vous entrez votre recherche (par exemple, "restaurants à Lyon") dans une interface claire, et quelques minutes plus tard, vous recevez un fichier CSV propre et exploitable.

Ces plateformes s'occupent de toute la complexité en coulisses : la gestion des proxies, la résolution des CAPTCHAs, la maintenance des robots... Vous, vous vous concentrez sur une seule chose : obtenir des données de qualité pour alimenter votre prospection. Si vous voulez un aperçu du marché, notre comparatif des meilleurs outils d'extraction web est un bon point de départ.

Le gain de temps et l'autonomie sont les vrais atouts ici. Un commercial peut lancer une extraction en trois clics, sans avoir à solliciter l'équipe technique. C'est de loin la solution la plus efficace pour obtenir des résultats rapides et à grande échelle.

Pour vous aider à visualiser, voici un petit tableau qui résume les avantages et inconvénients de chaque méthode.

Comparatif des méthodes d'extraction de données Google Maps

| Méthode | Avantages | Inconvénients | Idéal Pour |

|---|---|---|---|

| API Google Maps | • Fiable, stable et 100% légal • Données propres et structurées |

• Limité à 60 résultats par requête • Coûts potentiellement élevés • Compétences techniques requises |

Les projets à petite échelle ou les besoins très spécifiques et ponctuels. |

| Scraping via code | • Flexibilité maximale • Contrôle total sur les données extraites • Coût maîtrisé (hors infrastructure) |

• Complexité technique élevée • Maintenance constante obligatoire • Coûts cachés (proxies, CAPTCHAs) |

Les développeurs ou les entreprises avec une équipe technique dédiée pour des besoins sur mesure. |

| Outils no-code | • Très simple et rapide à utiliser • Pas de maintenance technique • Pensé pour les équipes commerciales |

• Moins de flexibilité que le code • Dépendance vis-à-vis d'un outil tiers • Coût d'abonnement mensuel |

Les équipes commerciales, marketing ou les entrepreneurs qui veulent des résultats rapides sans complexité technique. |

En résumé, le choix dépend vraiment de l'équilibre que vous cherchez entre contrôle, coût et simplicité. Pour la plupart des équipes qui visent la croissance, les outils no-code offrent le meilleur compromis.

Coder son propre scraper en Python

Pour les profils plus techniques qui n'ont pas peur de se retrousser les manches, coder son propre scraper est une aventure aussi formatrice que gratifiante. L'avantage principal ? Une flexibilité totale. Vous avez la main sur tout : les données à extraire, leur format, la logique métier. C'est la solution sur mesure par excellence.

Mais il faut être lucide. Google Maps n'est pas une cible facile. Le site est une forteresse moderne qui charge son contenu via JavaScript, change sa structure HTML au gré des mises à jour et déploie des protections anti-bots de plus en plus redoutables. Un simple script avec des bibliothèques comme requests ne fera pas long feu.

Votre projet s'inscrira dans l'une des trois grandes approches de l'extraction de données : la voie royale et structurée (API), la voie accessible (No-Code), et celle que nous explorons ici, la voie du contrôle absolu (le Code).

Choisir de coder son scraper en Python, c'est donc opter pour une maîtrise totale, au prix d'une complexité technique bien plus élevée.

Les outils indispensables du scraper

Pour dialoguer avec une page aussi interactive que Google Maps, il faut se comporter comme un utilisateur. C'est là que Selenium ou Playwright deviennent vos meilleurs alliés. Ces outils pilotent un vrai navigateur web (Chrome, Firefox...), lui font cliquer sur des boutons, remplir la barre de recherche et faire défiler les résultats. En bref, ils imitent à la perfection une navigation humaine.

Une fois que le contenu est visible à l'écran, il reste à le "lire". C'est le travail de Beautiful Soup, une bibliothèque Python qui transforme le code HTML de la page, souvent un peu chaotique, en un objet clair et structuré. Vous pouvez alors facilement y piocher les éléments qui vous intéressent : le nom de l'entreprise, son adresse, son numéro de téléphone.

La plus grande difficulté n'est pas d'écrire la première version du code. Le véritable défi, c'est la maintenance. Google change constamment les noms de ses classes HTML et la structure de ses pages. Votre scraper, parfaitement fonctionnel aujourd'hui, peut devenir obsolète demain sans une vigilance constante.

La structure de base d'un scraper Maps

La logique d'un scraper pour Google Maps suit un scénario assez prévisible. Voici les grandes étapes que votre code devra suivre :

- Lancer le navigateur : D'abord, on ouvre une fenêtre de navigateur automatisée avec Selenium.

- Faire une recherche : Ensuite, on navigue jusqu'à Google Maps, on tape la requête (par exemple, "plombiers à Paris") dans la barre de recherche et on simule un appui sur la touche "Entrée".

- Charger tous les résultats : La liste des entreprises ne s'affiche pas d'un coup. Il faut programmer un défilement (scroll) dans le panneau de gauche pour forcer le chargement de toutes les fiches.

- Extraire les informations : Pour chaque fiche affichée, on utilise les sélecteurs CSS ou XPath pour pointer précisément sur le nom, l'adresse, le site web... et on récupère le texte.

- Sauvegarder la récolte : Enfin, on enregistre toutes ces données bien propres dans un fichier structuré, comme un CSV ou un JSON, pour pouvoir les exploiter.

Dit comme ça, ça paraît simple. Mais chaque étape a ses subtilités, comme gérer les temps de chargement variables ou trouver des sélecteurs qui ne casseront pas à la prochaine mise à jour. Pour aller plus loin, notre guide complet sur le web scraping détaille ces concepts plus en profondeur.

Un exemple de code pour démarrer

Pour vous donner une idée concrète, voici un petit extrait de code. Il montre comment lancer une recherche avec Selenium et se préparer à l'extraction. C'est juste un point de départ, la base sur laquelle construire.

from selenium import webdriver

from selenium.webdriver.common.by import By

from selenium.webdriver.common.keys import Keys

import time

Initialiser le driver Chrome

driver = webdriver.Chrome()

Ouvrir Google Maps

driver.get("https://www.google.com/maps")

time.sleep(3) # On attend que la page se charge correctement

Trouver la barre de recherche et y taper notre requête

search_box = driver.find_element(By.ID, "searchboxinput")

search_box.send_keys("agences immobilières Lyon")

search_box.send_keys(Keys.ENTER)

time.sleep(5) # On laisse le temps aux résultats de s'afficher

C'est ici que la vraie magie commence :

il faudrait ajouter la logique de scroll et de parsing avec Beautiful Soup.

Une fois le travail terminé, on ferme le navigateur

driver.quit()

Cet exemple est volontairement minimaliste. Un vrai scraper de production inclurait une gestion fine des erreurs, des attentes dynamiques (WebDriverWait) pour s'adapter à la vitesse de chargement, et une logique bien plus robuste pour le défilement et l'extraction.

Passer sous les radars : la clé du succès

Développer un script qui fonctionne une fois, c'est le début. Le faire tourner à grande échelle sans se faire repérer et bloquer, c'est tout le jeu. C'est le principal obstacle pour quiconque veut scraper Google Maps. Google a mis en place des systèmes très performants pour repérer et neutraliser les robots.

Pour y parvenir, votre scraper doit se fondre dans la masse. Pensez "camouflage". Voici les trois piliers pour opérer discrètement :

- Rotation de proxies : N'utilisez jamais, au grand jamais, votre propre adresse IP. La solution est d'utiliser un service de proxies résidentiels rotatifs. Chaque requête partira d'une IP différente, rendant votre activité quasi indétectable.

- Comportement humain : Un robot est rapide et prévisible. Un humain, non. Intégrez des pauses aléatoires (

time.sleep()), variez la vitesse de défilement, simulez des mouvements de souris... tout ce qui peut briser la régularité mécanique de votre script. - Gestion des User-Agents : Faites croire à Google que vos requêtes viennent de partout. Changez régulièrement le

User-Agentpour vous faire passer pour un iPhone, puis un PC sous Windows avec Chrome, puis une tablette Android.

Cette complexité s'explique aussi par l'évolution de la plateforme. L'IA est désormais au cœur de Google Maps pour affiner les itinéraires et les recommandations. Ce n'est pas un hasard si 86 % des Français l'utilisent pour trouver des commerces locaux. Cette sophistication rend le scraping plus difficile mais les données d'autant plus précieuses. Vous pouvez d'ailleurs lire cette analyse détaillée sur l'évolution de Google Maps pour mieux comprendre le contexte.

Au final, construire son scraper Python est un projet exigeant mais qui offre un contrôle sans égal. Il faut juste être prêt à y investir du temps, non seulement en développement initial, mais surtout en maintenance pour s'adapter en permanence aux évolutions de Google.

Exploiter les outils no-code pour une extraction rapide

Pas besoin d'être développeur pour extraire des données. C'est une idée reçue qui a la vie dure. Aujourd'hui, l'extraction de données n'est plus l'apanage des profils techniques. Les outils no-code ont complètement changé la donne, rendant le scraping de Google Maps accessible en quelques clics.

Ces plateformes sont conçues pour être avant tout intuitives. Elles s'occupent de toute la complexité en coulisses — gestion des proxies, résolution des CAPTCHAs, maintenance du code — derrière une interface épurée. Votre seule mission, c'est de leur indiquer ce que vous cherchez.

Un workflow taillé pour la vitesse

Le processus est souvent d'une simplicité déconcertante, et c'est tout l'intérêt. Ces solutions sont pensées pour l'efficacité opérationnelle des équipes commerciales et marketing, pas pour des ingénieurs.

Concrètement, ça se passe comme ça :

- On définit la recherche : Vous tapez simplement votre requête, comme vous le feriez sur Google. Par exemple, "agences immobilières à Bordeaux" ou "restaurants végétariens à Lille".

- On lance l'extraction : Un clic sur un bouton, et l'outil se met au travail. Il navigue, collecte les informations et les structure proprement pour vous.

- On récupère le fichier : Quelques minutes plus tard, vous recevez une notification. Votre fichier de prospects, propre et au format CSV ou Excel, est prêt à être exploité.

Cette approche change radicalement la prospection. Une tâche qui engloutissait des jours de recherche manuelle et de copier-coller interminables est maintenant bouclée le temps d'une pause-café.

L'autonomie totale pour les équipes commerciales

Le plus gros avantage des outils no-code, c'est sans doute l'autonomie qu'ils offrent. Fini, les allers-retours avec l'équipe technique pour obtenir une liste de prospects. Un commercial peut générer lui-même ses fichiers de prospection, à la demande, en phase avec ses objectifs du moment.

Cette indépendance est un vrai coup d'accélérateur pour les cycles de vente. Au lieu d'attendre des données, les équipes peuvent saisir de nouvelles opportunités de marché quasi instantanément. Vous voulez lancer une campagne sur les hôtels d'une station de ski avant la saison d'hiver ? L'extraction peut être lancée en cinq minutes chrono.

On passe d'une mentalité où l'on se demande "comment obtenir les données ?" à une approche où la question devient "quelles données m'aideraient à cartonner cette semaine ?". La technologie n'est plus un frein, mais un catalyseur.

En plus, ces outils s'intègrent bien dans l'écosystème existant. Exporter les données vers un CRM comme HubSpot ou Salesforce, ou vers un outil d'e-mailing, devient une simple formalité. On peut ainsi créer des workflows automatisés où les nouveaux leads sont directement injectés dans les séquences de prospection. Notre article sur le no-code scraping détaille comment extraire des données sans être bloqué et approfondit ces notions.

Des scénarios B2B concrets avec un impact immédiat

Pour que ce soit plus parlant, imaginons quelques cas d'usage très réalistes pour une équipe de vente ou de marketing.

-

Scénario 1 : L'analyse concurrentielle locale

Une entreprise qui vend des logiciels de caisse veut s'implanter à Nantes. En quelques clics, elle peut sortir la liste de tous les restaurants et commerces de la ville. En analysant les avis, elle repère les établissements les mieux notés (parfaits pour un produit premium) et ceux qui se plaignent de leur système actuel. L'approche commerciale devient tout de suite ultra-personnalisée. -

Scénario 2 : La création d'une base de prospection qualifiée

Une agence web qui propose la création de sites internet peut lancer une recherche sur "plombiers à Marseille". Elle filtre ensuite les résultats pour ne garder que ceux qui n'ont aucun site web mentionné sur leur fiche Google. En quelques minutes, elle obtient une liste de prospects en or, avec un besoin criant.

Ces exemples montrent bien comment le no-code transforme une tâche autrefois technique en un puissant levier stratégique. Il démocratise l'accès à des données de grande valeur, et permet même aux plus petites équipes de rivaliser avec de grosses structures en matière d'intelligence commerciale.

Naviguer entre légalité et bonnes pratiques

Quand on parle de scraping, on met forcément les pieds dans un plat un peu sensible. La vraie question n'est pas de savoir si c'est techniquement faisable, mais plutôt de comprendre le terrain de jeu. Mieux vaut avancer en connaissance de cause pour éviter les mauvaises surprises, qu'elles soient d'ordre technique ou juridique.

Ce qui suit n'est pas un avis d'avocat, mais un guide de terrain pour vous aider à scraper Google Maps de manière responsable. L'idée est simple : vous donner les clés pour récupérer les données dont vous avez besoin, en limitant les risques au maximum.

Les conditions d'utilisation de Google : un avertissement à prendre au sérieux

Allons droit au but : les conditions de service de Google interdisent noir sur blanc le scraping. En utilisant des méthodes d'extraction automatisées en dehors de leur API officielle, vous êtes, techniquement, en infraction avec leur règlement.

Alors, on risque quoi concrètement ? Moins une action en justice (chose assez rare pour le scraping de données publiques) qu'un blocage technique, pur et simple. Google investit des fortunes pour protéger ses services, et sa sanction préférée est de bannir les adresses IP qui se comportent comme des robots. C'est exactement pour ça que l'utilisation de proxies et la simulation d'un comportement humain sont si cruciales.

L'enjeu, au fond, n'est pas tant la lettre de la loi que le respect de l'infrastructure. Une collecte trop agressive peut ralentir le service pour tout le monde, et c'est ça que Google cherche à bloquer avant tout. Votre priorité numéro un doit être de passer sous les radars.

Votre meilleure protection, c'est la modération. Limitez la cadence de vos requêtes, ne récupérez que les informations qui vous sont vraiment utiles et, surtout, évitez de bombarder leurs serveurs.

Le RGPD : la ligne à ne jamais franchir

Si les conditions de Google sont les règles du jeu, le RGPD, c'est la loi. Et c'est là que la distinction entre données d'entreprise et données personnelles devient absolument fondamentale.

- Les données d'entreprise : Le nom d'une société, son adresse, son numéro de téléphone professionnel ou son secteur d'activité sont des informations publiques. Les collecter dans un contexte B2B est généralement considéré comme légitime.

- Les données personnelles : Un avis laissé par "Jean Dupont", une photo où l'on reconnaît quelqu'un, ou une adresse e-mail du type

[email protected]sont des données personnelles. Leur collecte et leur traitement sont très strictement encadrés par le RGPD.

Pour rester dans les clous, votre scraping doit se limiter quasi exclusivement aux données B2B publiques. Le but est de contacter des entreprises, pas des individus. C'est une nuance vitale qui assure votre tranquillité.

Adopter une démarche éthique et responsable

Au-delà de la loi, il y a une question de bon sens et de respect. Les données sur Google Maps sont le fruit du travail de millions de gens. Chaque jour, à l'échelle mondiale, on compte plus de 15 millions de contributions, des avis aux photos. Il est d'ailleurs intéressant de noter qu'environ 15 à 20 % de ces contributions sont jugées non conformes, ce qui montre l'énorme effort de modération pour garantir la fiabilité des infos. Pour creuser le sujet, vous pouvez jeter un œil à cette analyse approfondie sur la transparence des contenus.

Pour que votre projet de scraping reste propre, voici quelques réflexes à adopter :

- Restez focus sur le B2B : Ciblez les infos d'entreprises, pas de personnes.

- Soyez transparent : Si vous utilisez ces données pour prospecter, soyez capable d'expliquer d'où elles viennent si on vous le demande.

- Respectez le "droit à l'oubli" : Proposez toujours un moyen simple pour que les entreprises contactées puissent se désinscrire de vos listes.

- Ne soyez pas gourmand : Votre scraping ne doit jamais dégrader l'expérience Google Maps des autres utilisateurs.

En résumé, s'aventurer dans cet univers demande un juste équilibre entre l'audace technique et la prudence. En gardant ces principes en tête, vous pouvez exploiter l'incroyable richesse des données de Google Maps pour votre croissance, tout en conservant une approche professionnelle et éthique.

Intégrer les données dans votre workflow de vente

Récupérer des milliers de contacts est une belle prouesse technique, mais ça ne reste qu'un point de départ. Le vrai défi, c'est de transformer cette matière brute en opportunités commerciales bien réelles. C'est là que tout le travail pour scraper Google Maps prend son sens : passer de la simple collecte à l'action. Sans un plan clair, votre fichier CSV fraîchement exporté risque de finir aux oubliettes.

La toute première étape, trop souvent zappée, c'est le nettoyage. Un export brut est rarement parfait : il peut y avoir des doublons, des numéros de téléphone dans tous les formats possibles ou des noms de boîtes mal orthographiés. Quelques fonctions de base sur Excel ou Google Sheets, comme la suppression des doublons ou la normalisation du texte, suffisent à faire un premier tri indispensable pour garantir la qualité de votre liste.

Ce travail de préparation est fondamental avant d'importer quoi que ce soit dans votre CRM. Un fichier propre, c'est l'assurance de mieux segmenter vos contacts, mais c'est surtout le meilleur moyen d'éviter de "polluer" votre base de données existante.

Injecter les leads dans votre CRM

Une fois les données propres et bien rangées, il faut les envoyer là où votre équipe commerciale passe ses journées : le CRM. Que vous utilisiez HubSpot, Salesforce ou Pipedrive, ces outils sont faits pour ça : centraliser et suivre chaque interaction.

L'import se fait généralement sans douleur avec un fichier CSV. La petite astuce, c'est de bien faire correspondre les colonnes de votre fichier avec les bons champs dans le CRM :

- Nom de l'entreprise va dans "Société"

- Adresse dans "Adresse du siège social"

- Site web dans "URL du site web"

- Note moyenne dans un champ personnalisé, par exemple "Note Google Maps"

Un conseil d'habitué : prenez le temps de créer des champs personnalisés dans votre CRM pour des données spécifiques comme la note Google ou le nombre d'avis. C'est ce qui vous permettra plus tard de créer des filtres et des campagnes ultra-ciblées, avec des angles que vos concurrents n'auront probablement pas.

En mettant en place un flux automatisé, vous alimentez en continu votre pipeline de vente avec de nouveaux prospects qualifiés, sans aucune manipulation manuelle. Vos commerciaux peuvent enfin se concentrer sur ce qu'ils font de mieux : vendre.

Personnaliser l'approche pour multiplier les réponses

C'est ici que la magie opère. La vraie puissance des données de Google Maps se révèle quand on les utilise pour personnaliser l'approche. Fini, les e-mails génériques qui commencent par un "Cher client" impersonnel. Vous avez maintenant entre les mains de quoi rendre chaque prise de contact pertinente et unique.

Imaginez l'impact d'un message qui ne se contente pas de vanter votre produit, mais qui prouve que vous avez fait vos recherches.

Exemple 1 : Pour une entreprise très bien notée

"Bonjour [Prénom], en cherchant les agences immobilières les mieux notées sur Lyon, votre nom est tout de suite ressorti avec plus de 150 avis positifs. Bravo pour cette réputation ! C'est justement pour aider les leaders comme vous à..."

Exemple 2 : Pour une entreprise avec une note moyenne

"Bonjour [Prénom], j'ai vu que votre restaurant à Bordeaux recevait quelques avis mitigés sur [point faible repéré dans les commentaires]. C'est intéressant, car notre solution aide justement les restaurateurs à améliorer ce point précis de l'expérience client..."

Exemple 3 : Pour une entreprise sans site web

"Bonjour [Prénom], votre boutique à Toulouse a l'air très appréciée localement, mais j'ai remarqué que vous n'aviez pas encore de site web. Saviez-vous que 80 % des clients font une recherche en ligne avant de se déplacer ? Ça pourrait être une piste intéressante à explorer ensemble..."

Cette méthode change complètement la donne. Vous ne tirez plus à l'aveugle ; vous démarrez une conversation sur la base d'éléments concrets et vérifiables. C'est toute la différence entre un e-mail qui atterrit directement dans la corbeille et celui qui décroche une réponse. En bouclant la boucle, de la collecte à l'activation, vous transformez vos efforts de scraping en chiffre d'affaires.

Les questions que tout le monde se pose sur le scraping de Google Maps

Quand on commence à s'intéresser au scraping de Google Maps, on se heurte vite à un mur de questions. C'est normal. Est-ce que c'est légal ? Quelles données valent vraiment le coup ? Et surtout, comment on fait pour ne pas se faire blacklister par Google ? On va mettre les choses au clair, question par question.

Alors, scraper Google Maps, on a le droit ou pas ?

C'est LA grande question, et la réponse n'est ni toute blanche, ni toute noire. Disons que c'est une zone grise. Techniquement, récupérer des informations publiques sur des entreprises (nom, adresse, téléphone) pour faire de la prospection B2B est généralement toléré. Après tout, ces infos sont visibles par n'importe qui.

Le vrai problème, c'est que cette pratique viole les conditions d'utilisation de Google. Le risque n'est donc pas tant d'avoir des ennuis avec la justice, mais plutôt de se faire repérer et de voir son adresse IP bannie. Par contre, attention : collecter des données personnelles, comme les noms des personnes qui laissent des avis, ça, c'est une autre histoire. Le RGPD est très clair là-dessus, et on ne joue pas avec ça.

Pour faire simple, restez pro et éthique. Ne prenez que les données d'entreprise dont vous avez besoin pour votre prospection. Et surtout, allez-y doucement pour ne pas bombarder les serveurs de Google. La discrétion, c'est la clé.

Concrètement, quelles sont les pépites à extraire pour une prospection efficace ?

Pour que votre prospection porte ses fruits, il faut aller chercher les informations qui vous permettront de vraiment personnaliser votre approche. Oubliez les listes génériques. Voici ce qui fait vraiment la différence :

- Le site web : C'est la porte d'entrée. En quelques clics, vous pouvez trouver un contact direct, comprendre ce que fait l'entreprise et voir si son site est à jour.

- La note moyenne et le nombre d'avis : Une mine d'or pour engager la conversation. Vous pouvez féliciter une entreprise qui cartonne ou, au contraire, proposer subtilement vos services à celle qui semble avoir des difficultés à satisfaire ses clients.

- Les informations manquantes : Une fiche sans site web ? Un numéro de téléphone qui n'est pas renseigné ? C'est un signal clair. Vous avez identifié un besoin immédiat que vous pouvez potentiellement combler.

Comment on fait pour passer sous les radars de Google ?

Pour éviter le carton rouge, votre outil de scraping doit se comporter comme un humain curieux, pas comme un robot déchaîné. Il y a trois règles d'or pour scraper Google Maps sans se faire éjecter.

- Utilisez des proxies résidentiels rotatifs : Imaginez changer de maison à chaque fois que vous toquez à une porte. C'est le principe. En changeant votre adresse IP à chaque requête, vous devenez quasiment invisible pour les systèmes de détection.

- Mettez des pauses aléatoires : Un humain ne clique jamais précisément toutes les 1,5 secondes. Intégrez des délais variables entre vos actions pour imiter un comportement naturel et casser le rythme mécanique.

- Changez de "User-Agent" : Faites croire à Google que vous naviguez tantôt depuis un Chrome sur PC, tantôt depuis un Firefox sur mobile. Cette variation rend votre activité beaucoup plus crédible.

En résumé, le secret, c'est de ne pas être gourmand. Modération et discrétion sont vos meilleurs alliés.

Faut-il partir sur un outil no-code ou coder sa propre solution ?

Le choix dépend totalement de qui vous êtes et de ce que vous voulez accomplir.

Si vous êtes commercial, dans le marketing ou à la tête d'une petite entreprise, votre objectif est simple : avoir des listes de prospects qualifiés, et vite. Vous n'avez pas le temps ni l'envie de mettre les mains dans le code. Dans ce cas, un outil no-code est la solution parfaite. C'est direct, efficace et pensé pour l'action.

À l'inverse, si vous êtes développeur et que votre projet demande une logique d'extraction très particulière ou une intégration poussée avec vos propres outils, alors créer votre scraper avec Python, par exemple, vous donnera une liberté totale. Tout est une question d'équilibre entre la simplicité que vous recherchez et le niveau de personnalisation dont vous avez besoin.

Pour passer de la théorie à la pratique sans vous arracher les cheveux, Scraap.ai vous aide à extraire, enrichir et qualifier vos prospects depuis Google Maps en quelques minutes. Prêt à lancer votre première campagne de prospection ? Rendez-vous sur https://www.scraap.ai/fr.