Un scraper Google Maps, c'est tout simplement un outil qui va chercher pour vous les informations publiques des entreprises répertoriées sur la carte. Pensez aux noms, adresses, numéros de téléphone, sites web... C'est un peu comme un assistant digital qui transforme la plus grande carte du monde en une base de données de prospects B2B, sans que vous ayez à y passer des heures manuellement.

Transformer Google Maps en un véritable vivier de prospects

Imaginez un instant pouvoir cartographier tout votre marché cible en à peine quelques clics. C'est exactement ce que permet un scraper Google Maps. Pour beaucoup d'équipes commerciales, on le sait, la recherche de prospects est le principal point de friction : c'est une tâche répétitive, chronophage, qui détourne les commerciaux de ce qu'ils font de mieux, c’est-à-dire vendre.

Cette technologie s'attaque précisément à ce problème. Au lieu de naviguer à la main sur la carte, de zoomer, de cliquer et de copier-coller des infos, le scraper agit comme un robot infatigable. Il va méthodiquement parcourir les zones géographiques et les catégories d'entreprises que vous lui indiquez pour en aspirer toutes les informations utiles.

Le gain de temps, un avantage qui change la donne

Le premier bénéfice, c'est évidemment le gain de productivité. C'est spectaculaire. Une tâche qui prendrait plusieurs jours à une personne est bouclée en quelques minutes à peine. Ce temps retrouvé permet aux équipes de se concentrer sur des actions à plus forte valeur ajoutée. Si vous voulez creuser les bases du scraping, notre guide sur le meilleur outil de scraping pourra vous éclairer.

Voyez-le comme un assistant commercial numérique qui bosse pour vous 24h/24 et 7j/7. Il ne se fatigue jamais et vous fournit des listes de contacts prêtes à l'emploi. Vous n'avez plus qu'à passer à la prise de contact.

Des données propres et structurées pour une prospection chirurgicale

Au-delà de la simple collecte, un bon scraper va aussi organiser ces données dans un format directement utilisable, comme un fichier CSV ou Excel. Et ça, c'est crucial pour la suite des opérations commerciales.

Concrètement, qu'est-ce que ça change ?

- Une segmentation précise : Vous pouvez filtrer les entreprises par secteur, par ville, ou même par note moyenne laissée par les clients. Idéal pour personnaliser votre approche.

- Une intégration facile au CRM : Importez ces listes en un clin d'œil dans votre logiciel de gestion de la relation client (CRM) pour suivre vos échanges et analyser vos résultats.

- Des campagnes d'outreach à grande échelle : Servez-vous de ces données pour lancer des campagnes d'emailing ou des appels à froid ciblés, avec la certitude que chaque contact est pertinent.

En automatisant la collecte et la structuration des données, un scraper Google Maps fait bien plus que vous faire gagner du temps. Il pose les fondations d'une stratégie de prospection plus intelligente, plus efficace et entièrement basée sur la donnée. Il libère vos équipes pour qu'elles puissent se concentrer sur leur cœur de métier : la vente.

Comment choisir la bonne méthode de scraping pour vos besoins

Pour aller chercher de la donnée sur Google Maps, plusieurs routes s'offrent à vous. Chacune a ses propres avantages, son niveau de complexité technique et, bien sûr, son coût. Bien comprendre ces différences est crucial pour choisir l'approche qui colle vraiment à vos compétences, votre budget et, surtout, à vos objectifs business.

Disons que vous êtes face à une immense bibliothèque. Vous pourriez lire chaque livre un par un, demander au bibliothécaire de vous sortir une liste précise, ou encore envoyer un petit robot scanner tous les rayons à votre place. Le scraping, c'est un peu la même idée, avec trois grandes approches.

1. Le parsing HTML : la méthode pour les puristes

La première méthode, c'est le parsing HTML. C'est un peu l'équivalent numérique de lire le code source d'une page web à la main. En gros, ça consiste à écrire un script (souvent en Python) pour disséquer la structure HTML de Google Maps et y pêcher les infos qui vous intéressent, comme le nom d'une boîte ou son numéro de téléphone.

C'est une super approche si vous avez des compétences en développement et que ça vous intéresse de mettre les mains dans le cambouis pour comprendre comment le web fonctionne. Le hic, c'est que cette méthode est assez fragile. Google change régulièrement la structure de ses pages, ce qui peut "casser" votre script du jour au lendemain et vous obliger à le mettre à jour sans arrêt. Et sans une gestion fine des proxies pour masquer vos requêtes, votre adresse IP risque de se faire blacklister très vite.

2. L'API Google Places : la voie officielle (et payante)

La deuxième option est d'utiliser l'API Google Places. C'est la porte d'entrée officielle que Google met à disposition. Imaginez un service de commande au volant : vous formulez une demande bien précise à Google, et il vous renvoie en retour des données propres, structurées, souvent au format JSON. C'est fiable, stable et 100 % légal.

Par contre, cette tranquillité d'esprit a un prix. L'API est payante, et la facture peut vite grimper si vous avez besoin de beaucoup de données. Le modèle de tarification de Google est basé sur le nombre de requêtes et peut atteindre 17 $ pour 1 000 requêtes. De plus, Google impose des limites assez strictes, notamment un plafond de 60 résultats par recherche, ce qui rend l'extraction massive de leads à la fois longue et coûteuse.

3. Les outils de scraping no-code : la solution clé en main

Enfin, la troisième méthode – et de loin la plus accessible pour les équipes commerciales ou marketing – est de passer par un google maps scraper dédié. Ces plateformes, qu'on appelle souvent "no-code", sont comme des navigateurs web intelligents et automatisés. Elles miment le comportement d'un utilisateur humain pour naviguer sur Google Maps et collecter les données pour vous.

Ces outils rendent le scraping accessible à tous. Plus besoin de savoir coder pour lancer des extractions complexes et récupérer des milliers de prospects qualifiés en quelques minutes.

Ces solutions s'occupent de toute la partie technique un peu pénible : la rotation des adresses IP pour ne pas se faire bloquer, la résolution des CAPTCHAs, et l'adaptation aux changements du site de Google. Vous avez juste à utiliser leur interface simple, définir votre cible (par exemple, "restaurants à Paris"), et vous recevez un fichier tout propre, prêt à être utilisé.

Pour vous aider à visualiser quelle approche choisir selon vos ressources, le tableau suivant compare les trois méthodes.

Comparaison des approches de scraping sur google maps

Ce tableau met en lumière les compromis entre la complexité technique, le coût, la fiabilité et l'échelle pour chaque méthode d'extraction de données sur Google Maps.

| Méthode | Complexité technique | Coût estimé | Fiabilité des données | Idéal pour |

|---|---|---|---|---|

| Parsing HTML | Élevée (nécessite du code) | Faible (coût des serveurs/proxies) | Variable (dépend de la maintenance) | Les développeurs et les projets sur-mesure |

| API Google Places | Moyenne (intégration API) | Élevé (paiement à l'usage) | Très élevée (données officielles) | Les applications nécessitant des données fiables à petite échelle |

| Outils No-Code | Très faible (interface utilisateur) | Modéré (abonnement mensuel) | Élevée (outils maintenus) | Les équipes marketing/commerciales pour la prospection |

En bref, si vous êtes développeur et que vous aimez le contrôle total, le parsing HTML est une option. Si vous avez le budget et besoin de données ultra-fiables pour une application, l'API est faite pour vous. Pour tous les autres, et notamment pour la génération de leads, les outils no-code offrent le meilleur équilibre.

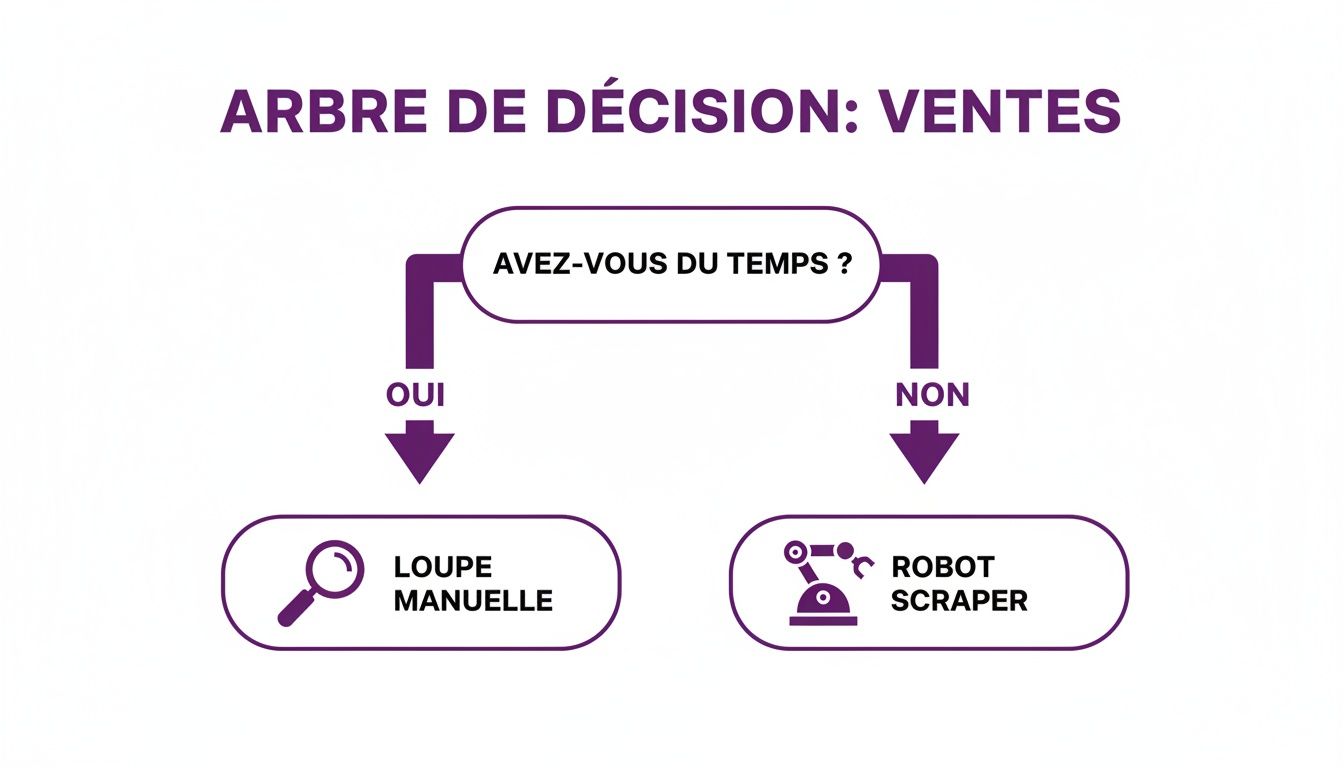

Ce petit arbre de décision résume bien le dilemme pour une équipe commerciale.

Ce qu'il faut retenir, c'est l'arbitrage central pour une équipe de vente : le temps. Si le temps n'est pas un problème, une recherche à la main peut faire l'affaire. Mais dès que l'efficacité devient la priorité, l'automatisation via un google maps scraper devient une évidence. C'est exactement là que des plateformes comme Scraap.ai interviennent, en proposant une solution puissante et simple pour accélérer drastiquement la génération de leads.

Naviguer entre les défis techniques et légaux du scraping

Utiliser un scraper Google Maps, c'est incroyablement puissant, mais soyons clairs : ce n'est pas un long fleuve tranquille. Pour que cet outil devienne un véritable atout sur le long terme, il est essentiel de bien comprendre les obstacles, qu'ils soient techniques (imposés par Google) ou juridiques (liés à la collecte de données). C'est en jonglant avec ces deux aspects que vous vous assurerez une prospection à la fois efficace, durable et conforme.

Imaginez Google comme le propriétaire d'un immense centre commercial. Il adore voir des visiteurs arpenter ses allées, mais il voit d'un mauvais œil les robots qui scannent méthodiquement chaque vitrine. Pour s'en protéger, il a mis en place toute une série de gardes-fous.

Surmonter les barrières techniques

Les meilleurs scrapers ne se contentent pas d'aspirer bêtement des informations. Ils miment un comportement humain pour passer sous les radars de Google, qui a plus d'un tour dans son sac pour repérer et bloquer les activités automatisées.

Voici les principaux défis que vous rencontrerez et comment les contourner :

- Blocages d'adresses IP : Si vous envoyez une avalanche de requêtes depuis la même adresse IP en un temps record, Google va vite la considérer comme suspecte et la blacklister. La parade la plus efficace ? La rotation de proxies. Cela consiste à utiliser un grand nombre d'adresses IP différentes, donnant l'impression que chaque requête provient d'un utilisateur unique et lambda.

- CAPTCHAs : Vous connaissez forcément ces tests "Je ne suis pas un robot", conçus spécifiquement pour faire barrage aux automates. Les outils de scraping modernes intègrent des services capables de résoudre ces CAPTCHAs automatiquement, en coulisses, sans que vous n'ayez à lever le petit doigt.

- Respect du fichier

robots.txt: Ce petit fichier, présent sur la quasi-totalité des sites web, est une sorte de code de bonne conduite. Il indique aux robots quelles pages ils ont le droit de visiter et celles qu'ils doivent laisser tranquilles. Un scraping éthique commence toujours par respecter ces règles du jeu.

Le meilleur scraper n'est pas celui qui force le passage en brute, mais celui qui se faufile avec intelligence et discrétion. Il ne s'agit pas d'un combat, mais plutôt d'une danse subtile avec les règles établies par Google.

Comprendre le cadre juridique et le RGPD

Au-delà de la technique, l'aspect légal est absolument central, surtout en Europe avec le fameux Règlement Général sur la Protection des Données (RGPD). La bonne nouvelle, c'est que scraper des données B2B publiques est tout à fait légal, à condition de bien respecter certaines règles.

Il est crucial de naviguer les défis légaux du scraping, notamment en comprenant les implications des politiques de confidentialité qui régissent l'usage des données. La clé est de faire la distinction entre une donnée professionnelle publique et une donnée personnelle.

- Donnée professionnelle publique : Une adresse comme

[email protected], un numéro de téléphone de standard ou l'adresse du siège social sont des informations publiques. Elles sont liées à l'entreprise (une personne morale), pas à un individu. Leur collecte pour de la prospection B2B est donc généralement autorisée. - Donnée personnelle : En revanche, une adresse e-mail nominative comme

[email protected]est une donnée personnelle. Le RGPD ne l'interdit pas, mais il encadre son utilisation. Vous devez justifier d'un intérêt légitime, informer la personne de ses droits (accès, rectification, opposition) et vous limiter aux données strictement nécessaires.

Le marché du scraping Google Maps en France a explosé, notamment grâce à des outils conçus pour être conformes dès le départ. Depuis l'arrivée du RGPD en 2018, environ 75 % des outils de scraping intègrent nativement des fonctions comme la rotation d'IP pour assurer une collecte respectueuse. En 2024, plus de 10 000 utilisateurs français ont adopté ces solutions et généré près de 40 millions de leads B2B, preuve que la pratique est devenue mature et efficace.

Au final, un scraping réussi repose sur deux piliers : une technologie solide qui déjoue les protections de manière éthique, et une compréhension claire du cadre légal pour une prospection en toute sérénité.

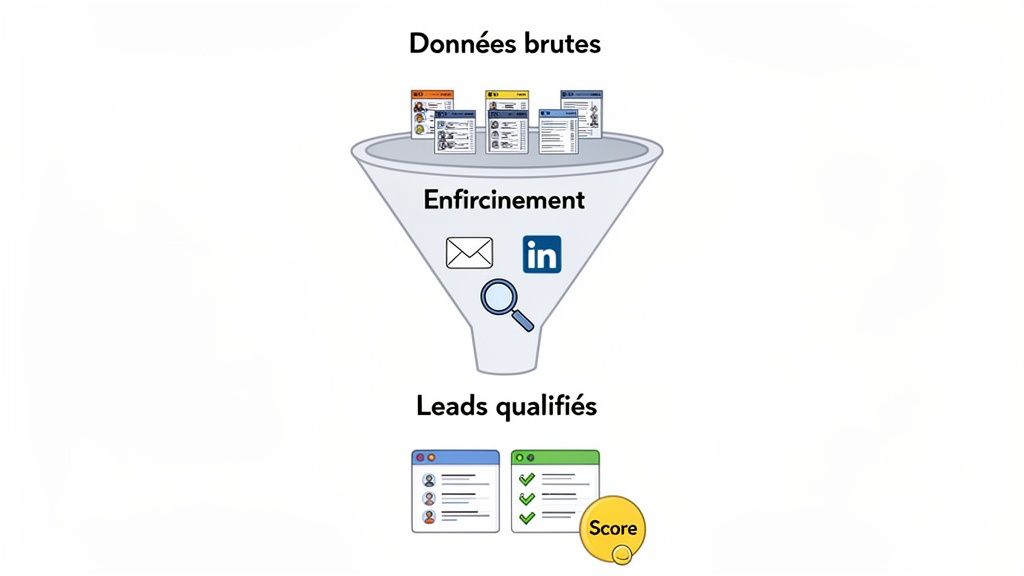

Transformer les données brutes en leads qualifiés

Récupérer une liste de noms et d'adresses avec un google maps scraper, c’est le point de départ. Mais soyons clairs : ce n’est que la première étape. En l'état, ces informations sont des données brutes, pas encore des prospects. Le vrai travail, celui qui transforme une simple extraction en moteur de croissance, c'est de métamorphoser ces données en leads qualifiés, prêts à être contactés.

Imaginez que vous avez un bloc d'argile. Vous avez la matière première, mais il faut encore la sculpter pour en faire quelque chose d'utile. En prospection B2B, ce processus de sculpture s'appelle l'enrichissement.

L'enrichissement des données au-delà de google maps

L'enrichissement, c'est l'art d'ajouter des couches d'informations décisives à vos données de base. Une fiche Google Maps vous donne un nom d'entreprise, une adresse, parfois un numéro de standard. C'est un bon début, mais c’est trop léger pour une approche commerciale qui fait mouche.

Pour passer à la vitesse supérieure, il faut trouver les réponses à des questions clés :

- Qui sont les vrais décisionnaires dans cette boîte (le PDG, le Directeur Marketing, le DSI) ?

- Quelles sont leurs adresses e-mail professionnelles directes ?

- Où trouver leurs profils LinkedIn pour une approche personnalisée et humaine ?

C'est là que des solutions tout-en-un changent la donne. Au lieu de passer des heures à chercher ces infos manuellement, des outils comme Scraap.ai automatisent ce travail fastidieux. Ils croisent les données extraites de Google Maps avec une multitude d'autres sources pour y ajouter ces contacts précieux, vous livrant un fichier de prospection directement exploitable. Si le sujet vous intéresse, notre guide sur l'enrichissement de base de données vous donnera toutes les clés.

De la donnée enrichie au lead qualifié

Avoir des contacts enrichis, c'est bien. Savoir lesquels prioriser, c'est infiniment mieux. Toutes les entreprises de votre liste n'ont pas le même potentiel. Certaines sont mûres pour acheter, d'autres pas du tout. La qualification des leads, c'est ce qui permet de faire le tri et de concentrer votre énergie là où le retour sur investissement est le plus fort.

La qualification transforme le bruit en signal. C'est l'art de distinguer les prospects "chauds", qui méritent une attention immédiate, des prospects "froids", à nourrir sur le long terme.

Cette qualification repose généralement sur plusieurs critères, souvent combinés dans un système de scoring de leads. Chaque prospect se voit attribuer une note en fonction de sa ressemblance avec votre client idéal (ICP - Ideal Customer Profile).

Les critères de scoring les plus courants sont :

- Données firmographiques : Le secteur d'activité, la taille de l'entreprise, sa localisation.

- Données technographiques : Les technologies que l'entreprise utilise déjà (un concurrent de votre solution, par exemple).

- Signaux d'affaires : Des événements récents qui signalent une opportunité, comme une levée de fonds, le recrutement d'un nouveau dirigeant, ou une vague d'embauches.

Par exemple, un cabinet d'avocats de plus de 50 employés (firmographique) à Paris qui vient de recruter un nouveau DSI (signal d'affaires) aura un score bien plus élevé pour un vendeur de logiciel juridique qu'une petite structure sans actualité marquante.

L'automatisation du scoring pour une efficacité maximale

Faire ce scoring à la main est non seulement long et pénible, mais aussi terriblement subjectif. Les plateformes modernes automatisent entièrement ce processus. Des solutions comme Scraap.ai ne se contentent pas d'extraire et d'enrichir ; elles intègrent des logiques de qualification. Vous définissez vos critères en amont, et l'outil vous sert une liste de prospects déjà triée sur le volet.

Cet enchaînement—extraction, enrichissement, qualification—crée une chaîne de génération de leads cohérente et redoutablement efficace. Il garantit que chaque appel, chaque e-mail de votre équipe commerciale, est dirigé vers un prospect à fort potentiel. C'est comme ça qu'on maximise le retour sur investissement de chaque action de prospection.

Scraap.ai : la solution no-code pour en finir avec la complexité

Scraper, c'est bien, mais quand on voit les obstacles techniques et légaux, on se dit qu'il faut une approche plus simple, pensée pour les équipes marketing et commerciales. C'est exactement le rôle des plateformes no-code : transformer une tâche de spécialiste en un processus fluide et accessible à tous, sans avoir à taper la moindre ligne de code.

Scraap.ai a été bâti sur cette idée. C'est un google maps scraper intelligent, oui, mais c'est surtout bien plus que ça. L'outil automatise toute la chaîne de prospection, de la simple collecte de données brutes sur Maps à la livraison d'une liste de prospects qualifiés et enrichis, prête à l'emploi.

Simplifier la génération de leads, pour de vrai

L'idée derrière Scraap.ai est de rendre la prospection B2B à la fois redoutable d'efficacité et incroyablement simple. Même si vous n'avez jamais fait ça de votre vie, le processus est conçu pour être direct.

Voyons comment ça marche, étape par étape :

- Définissez votre cible : Vous commencez par dire à l'outil ce que vous cherchez, comme vous le feriez sur Google Maps. Par exemple, "cabinets d'avocats à Lyon" ou "restaurants italiens à Bordeaux".

- Lancez l'extraction : Un seul clic suffit. Vous lancez le scraping, et Scraap.ai se met au travail. Il parcourt les fiches d'entreprises qui correspondent à votre recherche et récupère toutes les informations publiques disponibles.

- Recevez des prospects enrichis : C'est là que tout prend son sens. La liste brute est automatiquement transformée. La plateforme part à la chasse aux e-mails professionnels vérifiés, identifie les bons contacts (les décisionnaires), et complète les fiches avec des infos clés sur chaque entreprise.

Cette approche tout-en-un vous évite de jongler entre trois ou quatre outils différents : un pour scraper, un autre pour enrichir les contacts, un troisième pour vérifier les e-mails... Tout est centralisé pour vous faire gagner un temps précieux. Si les techniques pour éviter les blocages vous intéressent, jetez un œil à notre guide sur le no-code scraping et comment extraire des données web sans être bloqué.

L'avantage décisif des données en temps réel

Ce qui change vraiment la donne avec Scraap.ai, c'est son approche des données. Contrairement aux bases de contacts statiques, qui sont souvent obsolètes dès leur achat, Scraap.ai va chercher l'information à la source, au moment précis où vous en avez besoin.

Imaginez la différence entre consulter un annuaire papier imprimé l'an dernier et utiliser une carte interactive qui se met à jour à la seconde près. C'est exactement ça. Les données dynamiques vous garantissent une fraîcheur et une pertinence que les listes pré-compilées ne pourront jamais égaler.

Cette méthode vous assure de toujours travailler avec les informations les plus récentes. Dans le monde du B2B, où les gens changent de poste et les entreprises évoluent sans cesse, c'est absolument crucial.

Voici un aperçu de l'interface de Scraap.ai, pensée pour être la plus intuitive possible.

Comme vous pouvez le voir, définir ses critères et obtenir une liste de prospects parfaitement ciblée se fait sans aucune prise de tête technique.

En France, le scraping de Google Maps est devenu un réflexe pour de nombreuses équipes commerciales, surtout dans des secteurs comme l'immobilier ou les services aux entreprises. Scraap.ai, en plus d'être conçu dans le respect du RGPD, va plus loin en validant les e-mails et numéros de téléphone pour générer des listes ultra qualifiées. Une agence parisienne, par exemple, a récemment scrapé 5 000 restaurants et commerces. Résultat ? 85 % de contacts vérifiés et un taux de conversion sur ses campagnes de prospection qui a tout simplement doublé.

Des applications concrètes pour booster votre croissance

La vraie valeur d'un outil comme celui-ci se mesure à travers ses applications pratiques. On ne parle pas juste de trouver des adresses, mais de dénicher de vraies opportunités d'affaires.

Quelques exemples concrets :

- Trouver des clients par technologie : Une agence web peut cibler tous les commerces d'une ville dont le site n'est pas optimisé pour le mobile.

- Cibler les nouvelles ouvertures : Un fournisseur de services peut repérer tous les nouveaux restaurants ou magasins pour leur proposer une offre de bienvenue.

- Analyser la concurrence locale : Un commercial peut lister tous les concurrents dans sa zone pour étudier leur positionnement et leur réputation en ligne.

Pour les PME et les startups, cette capacité à générer des listes de prospects ultra-ciblés en quelques minutes est un véritable accélérateur. Cela démocratise une approche de la prospection basée sur la donnée, qui était autrefois l'apanage des grandes entreprises avec de gros moyens techniques.

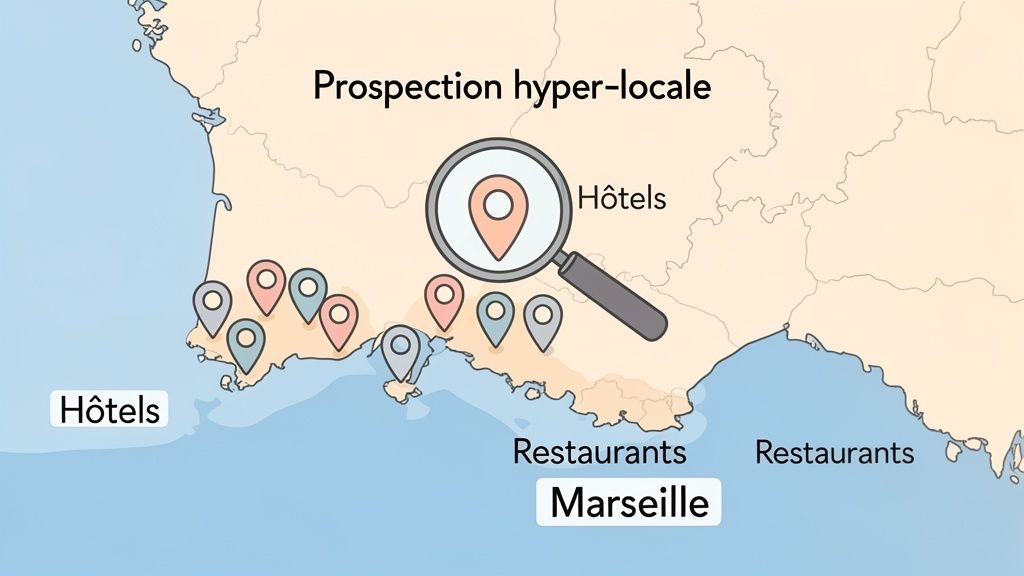

Le scraping, une arme redoutable pour la prospection hyper-locale

Pour bien comprendre la puissance d'un google maps scraper, rien de mieux qu'un cas concret. La prospection hyper-locale est sans doute l'une des applications les plus parlantes. C'est l'art de transformer une vaste zone géographique en un terrain de chasse commercial parfaitement quadrillé.

Prenons l'exemple d'un commercial basé à Marseille. Son but du jeu ? Dénicher des entreprises très spécifiques en Provence-Alpes-Côte d'Azur (PACA) pour que chaque appel, chaque email, ait un maximum d'impact. Plutôt que de s'épuiser dans des recherches manuelles interminables, il va utiliser un scraper pour automatiser le travail et repérer des pépites invisibles à première vue.

Cibler des niches avec la précision d'un laser

Grâce à un scraper, notre commercial peut lancer des extractions ultra-ciblées en quelques minutes. Ces listes de prospects ne sont pas de simples annuaires. Elles sont le résultat d'une véritable stratégie.

Imaginons deux missions pour lui :

- Scénario 1 : Proposer une solution de réservation. En un clic, il extrait la liste complète de tous les hôtels indépendants de la Côte d'Azur. Il suffit d'exclure les grandes chaînes pour obtenir une base de contacts en or, prête à être démarchée pour sa nouvelle solution de réservation en ligne.

- Scénario 2 : Vendre un service d'e-réputation. Autre idée : il dresse la liste de tous les restaurants de la région affichant une note Google inférieure à 3,5 étoiles. Cette liste est une véritable mine d'or. Chaque restaurant contacté a un problème identifié, ce qui rend son offre de gestion d'avis immédiatement pertinente.

Dans les deux cas, le scraping ne se contente pas de fournir des contacts. Il qualifie le besoin en amont, ce qui rend l'approche commerciale infiniment plus efficace.

La puissance des données locales

Cette méthode est particulièrement redoutable dans des régions aussi dynamiques que PACA. Le scraping sur Google Maps excelle dans l'analyse de terrain. À Nice, par exemple, des extractions massives peuvent couvrir jusqu'à 13 régions administratives. Pour 2025, on estime à environ 45 000 le nombre de commerces extractibles en PACA, avec un taux de contacts valides qui pourrait atteindre 80% pour les équipes commerciales.

Les chiffres parlent d'eux-mêmes : 70 % des growth marketers niçois se servent déjà de Maps pour cartographier leurs concurrents. Ils extraient plus de 2 000 points d'intérêt chaque mois, ce qui leur permet de booster leurs campagnes de prospection de 35%.

L'approche hyper-locale change complètement les règles du jeu. Elle permet aux PME et aux agences de terrain de rivaliser avec les grands acteurs en devenant maîtres de leur propre marché, armées d'une connaissance client inégalée.

Cette segmentation fine peut s'appliquer à une multitude de secteurs. Vous pourriez, par exemple, vouloir créer une liste des meilleurs services de livraison de repas dans un quartier précis pour leur proposer une solution logistique ou marketing. Le scraping transforme Google Maps en un puissant outil stratégique pour quiconque veut conquérir un marché local avec une précision chirurgicale.

Vos questions, nos réponses sur le scraping de Google Maps

Vous avez encore quelques interrogations ? C'est tout à fait normal. On a regroupé ici les questions qui reviennent le plus souvent pour dissiper les derniers doutes sur l'utilisation d'un scraper Google Maps.

Est-ce que j'ai le droit de scraper Google Maps en France ?

Oui, la collecte des informations publiques affichées sur Google Maps est parfaitement légale. On parle ici des données professionnelles que n'importe qui peut voir : nom de l'entreprise, adresse, numéro de téléphone du standard... Ces informations sont dans le domaine public, donc leur extraction ne pose pas de problème.

Là où il faut être vigilant, c'est quand on touche à des données personnelles, comme une adresse e-mail qui permet d'identifier quelqu'un (pré[email protected]). À ce moment-là, le RGPD entre en jeu. Pour une prospection B2B, cela veut dire que vous devez pouvoir justifier d'un "intérêt légitime", informer les personnes contactées de leurs droits (opposition, suppression, etc.) et vous limiter aux données vraiment utiles pour votre démarche.

Heureusement, les outils professionnels comme Scraap.ai sont conçus pour naviguer dans ce cadre. Ils se concentrent sur les données d'entreprise publiques, vous aidant à rester du bon côté de la loi.

Concrètement, combien de contacts je peux espérer obtenir ?

Le nombre de leads que vous pouvez extraire dépend de deux choses : l'outil que vous utilisez et la zone géographique que vous visez. Si vous faites une recherche manuelle sur le site de Google Maps, vous vous heurterez vite à un mur : l'affichage est plafonné à environ 200 résultats par recherche. C'est très peu pour nourrir une prospection sérieuse.

La vraie force d'un bon scraper, c'est sa capacité à faire sauter ce verrou. Au lieu de lancer une seule grosse recherche, il va en lancer des centaines de petites, très ciblées, pour couvrir méticuleusement tout un territoire.

Un scraper efficace va, en quelque sorte, poser une grille sur la carte. Il découpe automatiquement une grande zone, comme une région, en une multitude de petits carrés et lance une recherche pour chacun d'eux. Grâce à cette technique de "quadrillage", des plateformes comme Scraap.ai peuvent aller chercher des milliers, parfois même des dizaines de milliers de leads qualifiés en une seule fois. Tout dépend bien sûr de la densité d'entreprises dans le secteur et la région que vous avez choisis.

Faut-il être un pro de l'informatique pour utiliser un scraper ?

Plus maintenant, et c'est une excellente nouvelle ! Il y a quelques années, il fallait effectivement savoir coder pour se lancer dans le scraping. Des méthodes comme le parsing HTML demandaient de sérieuses compétences techniques. Aujourd'hui, le paysage a complètement changé avec l'arrivée de plateformes "no-code" pensées pour les équipes commerciales, marketing ou les indépendants.

Ces outils, et Scraap.ai en est le parfait exemple, sont conçus pour être aussi simples qu'un formulaire en ligne. L'interface vous prend par la main : vous choisissez votre cible via des menus déroulants ("boulangeries"), vous indiquez le lieu ("Lyon et ses alentours"), et vous cliquez sur un bouton pour lancer la machine.

Toute la partie compliquée — la gestion des serveurs, des blocages, des CAPTCHAs, la mise à jour du code — est gérée en arrière-plan par la plateforme. Vous n'avez besoin d'aucune ligne de code pour obtenir des listes de prospects professionnelles, prêtes à être utilisées.

Passez d'une prospection manuelle fastidieuse à un processus simple et automatisé. Avec Scraap.ai, accédez à des milliers de leads qualifiés en quelques clics, sans aucune compétence technique. Découvrez la puissance de Scraap.ai dès aujourd'hui.